- Multimodale KI entwickelt sich von der „unabhaengigen Verarbeitung einzelner Modalitaeten" hin zum „nativen multimodalen Verstaendnis" -- GPT-4V[3] und Gemini[4] demonstrieren bahnbrechende Leistungen von Vision-Language-Modellen bei Dokumentenverstaendnis, Diagramminterpretation und Analyse realer Szenarien

- Das Contrastive-Learning-Framework von CLIP[1] bildet den Grundstein fuer das Vision-Language-Alignment und ermoeglicht es, Bilder und Text im selben semantischen Raum zu vergleichen, abzurufen und zu interpretieren

- Open-Source-Projekte wie LLaVA[6], MiniGPT-4[8] und BLIP-2[5] haben gezeigt, dass auch mit relativ begrenzten Ressourcen wettbewerbsfaehige Vision-Language-Modelle aufgebaut werden koennen, was Unternehmen einen gangbaren Weg fuer den privaten Einsatz eroeffnet

- Qualitaetskontrolle in der Fertigung, Unterstuetzung bei der medizinischen Bildgebung und intelligente Kaufberatung im Einzelhandel -- multimodale KI erzeugt in diesen Bereichen quantifizierbaren Geschaeftswert, wobei Halluzinationen und Sicherheit nach wie vor die zentralen Herausforderungen fuer den produktiven Einsatz darstellen

1. Von Unimodal zu Multimodal: Die Art, wie KI die Welt versteht, veraendert sich

Menschen verstehen die Welt nie ueber nur einen einzigen Sinn. Wir „sehen" ein Diagramm, „lesen" die Beschriftung darunter, „hoeren" die muendliche Analyse eines Kollegen zu diesem Diagramm -- und verschmelzen all diese Informationen in unserem Kopf zu einem einheitlichen Verstaendnis. Die KI-Forschung der letzten Jahrzehnte verlief jedoch groesstenteils entlang einzelner Modalitaeten (Modalities): Computer Vision verarbeitete Bilder, Natural Language Processing (NLP) verarbeitete Text und Spracherkennung verarbeitete Audio.

Dieses „unimodale Denken" dominierte die gesamte Branche bis 2021. Wenn Unternehmen gleichzeitig Bilder und Text verarbeiten mussten, bestand der uebliche Ansatz darin, ein Bilderkennungsmodell und ein Textanalysemodell separat bereitzustellen und dann durch Engineering-Teams Regeln zu schreiben, um die Ausgaben beider zusammenzufuegen. Diese Architektur war nicht nur umstaendlich -- das fundamentalere Problem lag darin, dass sie die semantischen Zusammenhaenge zwischen den Modalitaeten nicht erfassen konnte. Die subtile Korrespondenz zwischen einem Foto eines Produktdefekts und dem zugehoerigen Qualitaetsbericht wurde in traditionellen Pipelines vollstaendig ignoriert.

2021 markierte den Wendepunkt. OpenAI veroeffentlichte CLIP (Contrastive Language-Image Pre-training)[1] und zeigte erstmals, dass kontrastives Lernen auf 400 Millionen Bild-Text-Paaren es einem Modell ermoeglichen kann, Bilder und Text im selben semantischen Raum zu verstehen. Fast zeitgleich demonstrierten Tsimpoukelli et al.[9], dass das „Einschleusen" visueller Merkmale in ein eingefrorenes Sprachmodell multimodales Few-Shot-Learning ermoeglichen kann. Diese Forschungsarbeiten offenbarten eine grundlegende Erkenntnis: Es ist nicht noetig, ein voellig neues multimodales Modell von Grund auf zu trainieren -- man muss nur lernen, wie Repraesentationen verschiedener Modalitaeten im selben Raum miteinander kommunizieren koennen.

Die Entwicklung danach war rasant. 2022 brachte DeepMind Flamingo[2] heraus, 2023 stellte OpenAI GPT-4V[3] vor, Google praesentierte Gemini[4], und die Open-Source-Community brachte eine Reihe leistungsstarker Vision-Language-Modelle wie LLaVA[6] und BLIP-2[5] hervor. Yin et al. stellen in ihrem Ueberblick[7] fest, dass Multimodal Large Language Models (Multimodal LLM) bis 2024 zu einem der am schnellsten wachsenden Teilbereiche der KI-Forschung geworden sind. Fuer Unternehmen ist dies keine „Zukunftstechnologie" mehr, sondern eine Faehigkeit, die „jetzt einsatzbereit" ist.

2. Grundlegende Architektur: CLIP und der Durchbruch des kontrastiven Lernens

Um die technischen Grundlagen multimodaler KI zu verstehen, muss man bei CLIP[1] beginnen. Die Kernidee von CLIP ist gleichermassen elegant wie radikal: Anstatt fuer jede visuelle Aufgabe grosse Mengen spezifischer Labels zu annotieren, nutzt man direkt die natuerlich im Internet vorhandenen Bild-Text-Paare -- Bilder und ihre Textbeschreibungen -- um einen universellen Vision-Language-Alignment-Raum zu erlernen.

2.1 Der Mechanismus des kontrastiven Lernens

Das Trainingsziel von CLIP laesst sich intuitiv verstehen: Gegeben eine Charge von N Bild-Text-Paaren muss das Modell lernen, zusammengehoerige Bild-Text-Paare naeher zusammenzubringen und gleichzeitig nicht zusammengehoerige Bild-Text-Paare weiter voneinander zu entfernen. Konkret erzeugt das Bild ueber einen Vision Encoder einen visuellen Embedding-Vektor, der Text ueber einen Text Encoder einen Text-Embedding-Vektor, und beide werden in einen gemeinsamen semantischen Raum gleicher Dimension projiziert. Waehrend des Trainings wird eine N x N Aehnlichkeitsmatrix berechnet, wobei ein symmetrischer Kreuzentropieverlust die Maximierung der Aehnlichkeit der Diagonalelemente (korrekte Paare) antreibt.

Dieses scheinbar einfache Framework erzielte erstaunliche Ergebnisse. CLIPs Zero-Shot-Klassifizierungsgenauigkeit auf ImageNet erreichte ein Niveau, das mit einem voll ueberwacht trainierten ResNet-50 vergleichbar ist -- ohne jegliche ImageNet-Annotationsdaten. Noch wichtiger ist, dass die von CLIP erlernten Repraesentationen eine extrem starke Uebertragungsfaehigkeit besitzen: Sie koennen jedes visuelle Konzept verstehen, das in natuerlicher menschlicher Sprache beschrieben wird, anstatt auf vordefinierte Klassenlabels beschraenkt zu sein.

2.2 Die revolutionaere Bedeutung des Zero-Shot-Transfers

CLIPs Zero-Shot-Faehigkeit hat tiefgreifende Auswirkungen auf Unternehmensanwendungen. Traditionelle Computer-Vision-Systeme erfordern fuer jede neue Aufgabe das Sammeln und Annotieren grosser Datenmengen -- was in industriellen Szenarien oft der teuerste und zeitaufwaendigste Schritt ist. Ein auf CLIP basierendes System hingegen benoetigt lediglich eine natuerlichsprachliche Beschreibung der neuen Klassifizierungskriterien (z. B. „zerkratztes Panel" vs. „einwandfreies Panel"), um sofort Inferenzen durchzufuehren, ohne zusaetzliche Annotation und Trainingslaeufe.

CLIP hat jedoch auch grundlegende Einschraenkungen. Es kann nur Matching und Retrieval zwischen Bildern und Text durchfuehren, ist aber nicht in der Lage, offene visuelle Frage-Antwort-Aufgaben (VQA) oder Bildbeschreibungsgenerierung auszufuehren. Mit anderen Worten: CLIP ermoeglicht es dem Modell zu „verstehen", worum es in einem Bild geht, aber nicht, „auszudruecken", was es sieht. Um einen echten Vision-Language-Dialog zu realisieren, bedarf es der naechsten Generation von Vision-Language-Modellen -- und genau das ist das Problem, das Flamingo, GPT-4V und andere Modelle loesen wollen.

3. Die Evolution der Vision-Language-Modelle: Von Flamingo bis GPT-4V

Wenn CLIP die „Bruecke" zwischen Vision und Sprache geschlagen hat, dann haben Vision-Language-Modelle (Vision-Language Model, VLM) auf dieser Bruecke eine bidirektionale Schnellstrasse errichtet. Das Ziel von VLMs ist nicht nur das Bildverstaendnis, sondern auch die Faehigkeit, in natuerlicher Sprache zu argumentieren, Fragen zu beantworten und sogar detaillierte visuelle Analyseberichte zu erstellen.

3.1 Flamingo: Der Pionier des Few-Shot-Multimodal-Lernens

Das 2022 von DeepMind vorgestellte Flamingo[2] war das erste grosse Modell, das echte multimodale Few-Shot-Faehigkeiten demonstrierte. Sein Architekturdesign ist aeusserst aufschlussreich: Flamingo fror den vortrainierten Vision Encoder und das Sprachmodell ein und trainierte nur das verbindende „Perceiver Resampler"-Modul und die Gated-Cross-Attention-Schichten. Der Perceiver Resampler komprimiert visuelle Features variabler Laenge in eine feste Anzahl visueller Tokens, die dann ueber Cross-Attention in jede Schicht des Sprachmodells eingespeist werden.

Die Eleganz dieses Designs liegt darin: Durch das Training nur der zwischenliegenden „Klebstoff"-Module bewahrte Flamingo die jeweiligen leistungsstarken Faehigkeiten des Vision Encoders und des Sprachmodells und lernte gleichzeitig, wie beide zusammenarbeiten koennen. In 16 Vision-Language-Benchmark-Tests erreichte Flamingo mit nur 32 Few-Shot-Beispielen bei 6 Aufgaben den Stand der Technik.

3.2 GPT-4V: Ein Meilenstein der universellen multimodalen Intelligenz

Im September 2023 erweiterte OpenAI GPT-4 um visuelle Verstaendnisfaehigkeiten (GPT-4V / GPT-4 Vision)[3]. Obwohl OpenAI die vollstaendigen Architekturdetails von GPT-4V nicht offengelegt hat, versetzte seine Leistung die gesamte Branche in Erstaunen: GPT-4V konnte komplexe Diagramme und Datenvisualisierungen verstehen, handgeschriebenen Text lesen, medizinische Bilder analysieren und den Humor von Memes interpretieren -- jede dieser Aufgaben war zuvor ein eigenstaendiges Forschungsgebiet.

Der bahnbrechende Aspekt von GPT-4V liegt in seiner Universalitaet. Es ist kein fuer eine spezifische visuelle Aufgabe feinabgestimmtes Modell, sondern ein System, das nahezu jede visuelle Eingabe verstehen und in natuerlicher Sprache darueber argumentieren kann. Dies bedeutet, dass Unternehmen nicht drei separate Modelle fuer Dokumentenverstaendnis, Qualitaetskontrolle und Bildanalyse bereitstellen muessen -- ein einziges GPT-4V kann all diese Szenarien abdecken.

3.3 Gemini: Der Ehrgeiz nativer Multimodalitaet

Googles im Dezember 2023 vorgestelltes Gemini[4] schlug einen anderen Weg ein: Anstatt visuelle Faehigkeiten an ein bestehendes Sprachmodell „anzuschliessen", wurde ein nativ multimodales Modell von Grund auf trainiert. Gemini empfing bereits in der Pretraining-Phase gleichzeitig Text, Bilder, Audio, Video und andere Modalitaeten, was ein tieferes Verstaendnis der Cross-Modal-Beziehungen ermoeglicht. In mehreren Benchmark-Tests zeigte Gemini Ultra eine mit GPT-4V vergleichbare oder sogar ueberlegene Leistung, insbesondere bei Aufgaben, die visuelle Argumentation ueber lange Kontexte erfordern.

4. Cross-Modal-Fusionsstrategien: Early vs. Late Fusion

Eine der zentralen architektonischen Entscheidungen bei multimodalen Modellen ist, wie und wann die Informationen verschiedener Modalitaeten zusammengefuehrt werden. Diese Frage mag technisch erscheinen, beeinflusst aber tiefgreifend die Faehigkeitsgrenzen und Bereitstellungskosten eines Modells. Die akademische Forschung unterscheidet ueblicherweise drei Hauptkategorien von Fusionsstrategien: Early Fusion, Late Fusion und Hybrid Fusion.

4.1 Early Fusion

Die Kernidee der Early Fusion ist: Bereits in der fruehesten Verarbeitungsphase des Modells werden alle Modalitaetseingaben zu einer einheitlichen Repraesentationssequenz zusammengefuehrt. Gemini[4] ist ein typischer Vertreter der Early Fusion -- es verkettet Bild-Tokens, Text-Tokens und Audio-Tokens zu einer einzigen Sequenz, die dann von einer einheitlichen Transformer-Architektur verarbeitet wird. Ebenso kodiert PaLM-E[10] Sensordaten von Robotern, Bildmerkmale und Textanweisungen einheitlich, sodass das Sprachmodell die physische Welt direkt „wahrnehmen" kann.

Der Vorteil der Early Fusion liegt darin, dass das Modell von der untersten Ebene an Cross-Modal-Interaktionsmuster erlernen kann -- die feinkornige Korrespondenz zwischen einem bestimmten Bereich eines Bildes und einem bestimmten Wort im Text kann in jeder Schicht der Attention-Berechnung erfasst werden. Der Preis ist jedoch ein enormer Rechenaufwand: Die Sequenzlaenge nach der Bild-Tokenisierung erreicht oft Hunderte oder sogar Tausende von Tokens, und nach der Verkettung mit Text-Tokens wird die O(n^2)-Komplexitaet der Self-Attention zum Engpass.

4.2 Late Fusion

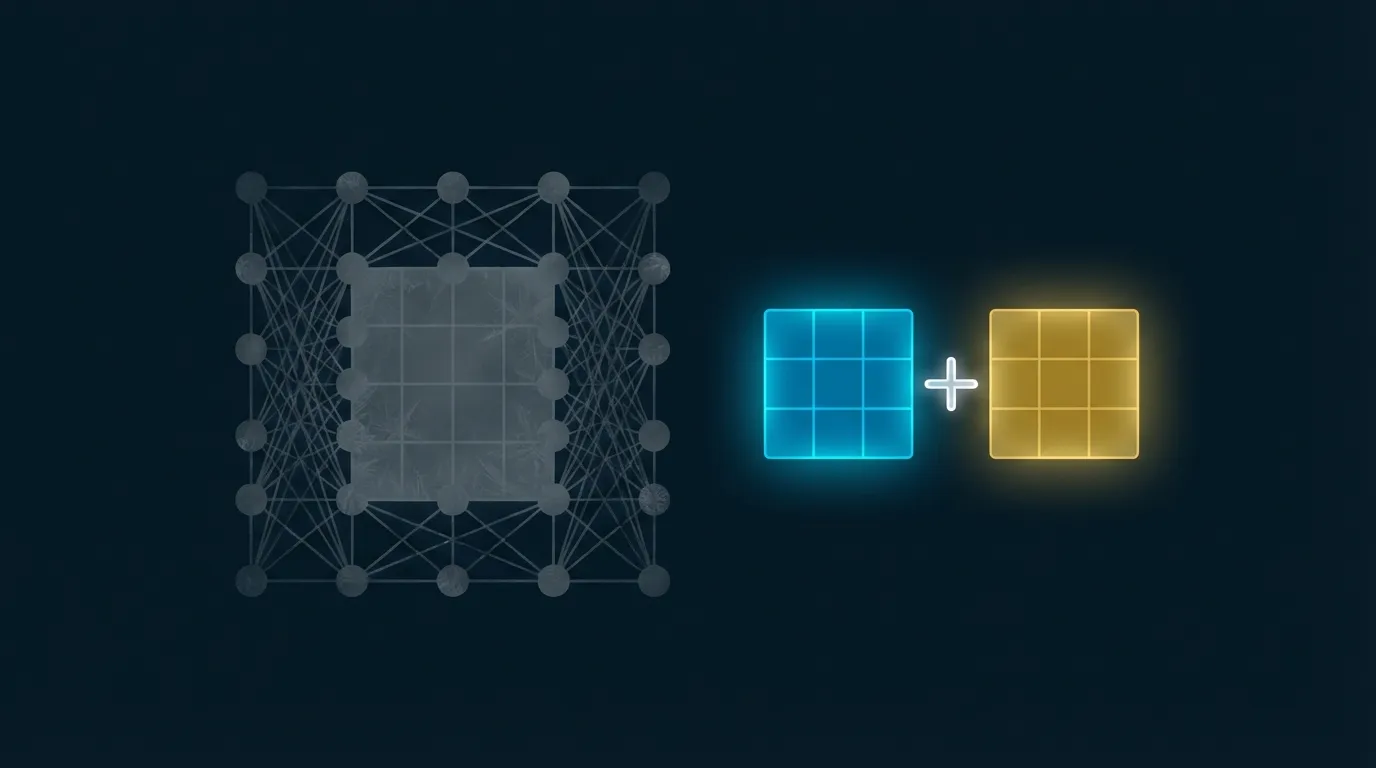

Die Late-Fusion-Strategie geht den umgekehrten Weg: Jede Modalitaet wird zunaechst von einem eigenstaendigen Encoder bis zur hochrangigen semantischen Repraesentation verarbeitet und erst dann auf hoeherer Ebene zusammengefuehrt. CLIP[1] ist ein typisches Beispiel fuer Late Fusion -- Bilder und Text werden jeweils von unabhaengigen Encodern verarbeitet und nur im endgueltigen Embedding-Raum ueber Kosinusaehnlichkeit verglichen. Dieser Ansatz ist recheneffizient und die einzelnen Modalitaets-Encoder koennen unabhaengig vortrainiert und skaliert werden, allerdings auf Kosten der feinkornigen Cross-Modal-Interaktionsfaehigkeit.

4.3 Hybrid Fusion

Die derzeit erfolgreichsten Vision-Language-Modelle verwenden ueberwiegend eine Hybrid-Fusion-Strategie. Flamingos[2] Cross-Attention-Design ist ein klassisches Beispiel: Visuelle Merkmale werden von einem eigenstaendigen Encoder extrahiert (Late-Fusion-Element), dann aber ueber Cross-Attention-Schichten in jede Schicht des Sprachmodells eingespeist (Early-Fusion-Element). BLIP-2[5] fuehrte den Q-Former als leichtgewichtige Cross-Modal-„Bruecke" ein, die eine Verbindung zwischen dem eingefrorenen Vision Encoder und dem eingefrorenen Sprachmodell herstellt.

Fuer Unternehmen bestimmt die Wahl der Fusionsstrategie direkt die Bereitstellungsarchitektur. Late Fusion eignet sich fuer latenzempfindliche Szenarien, in denen einzelne Modalitaeten unabhaengig skaliert werden muessen (z. B. grosse Bild-Text-Retrieval-Systeme); Early/Hybrid Fusion eignet sich fuer Szenarien, die tiefe Cross-Modal-Argumentation erfordern (z. B. Dokumentenverstaendnis, Visual Question Answering). Das Verstaendnis dieser technischen Abwaegungen ist die Voraussetzung fuer richtige Architekturentscheidungen.

5. Open-Source-Multimodal-Modelle: LLaVA, MiniGPT-4 und BLIP-2

Die Faehigkeiten von GPT-4V und Gemini sind beeindruckend, aber beide sind geschlossene kommerzielle Dienste. Fuer Unternehmen mit Datenschutzanforderungen, dem Bedarf an lokaler Bereitstellung oder dem Wunsch nach individuellem Finetuning bieten Open-Source-Multimodal-Modelle einen aeusserst wichtigen alternativen Weg. Zwischen 2023 und 2024 erzielte die Open-Source-Community in diesem Bereich bemerkenswerte Fortschritte.

5.1 BLIP-2: Effiziente modulare Architektur

Salesforces BLIP-2[5] schlug eine ingenieurtechnisch aeusserst kluge Architektur vor: Ein leichtgewichtiges Q-Former-Modul (Querying Transformer) verbindet einen eingefrorenen Vision Encoder (wie ViT-G) mit einem eingefrorenen grossen Sprachmodell (wie FlanT5-XXL oder OPT). Der Q-Former enthaelt eine Reihe lernbarer Abfragevektoren (Learned Queries), die ueber Cross-Attention die fuer die Sprache relevantesten visuellen Informationen aus dem Vision Encoder „destillieren" und dann diese komprimierten visuellen Tokens dem Sprachmodell zufuehren.

Die Eleganz dieses Designs liegt darin: Die trainierbaren Parameter machen nur einen kleinen Bruchteil des Gesamtmodells aus (ca. 188 Millionen), koennen aber vortrainierte Modelle mit Milliarden von Parametern effektiv multimodales Verstaendnis erlernen lassen. BLIP-2 erzielte die damalige Bestwertung bei Zero-Shot Visual Question Answering (VQAv2), waehrend die Trainingskosten nur einen Bruchteil des Trainings von Grund auf betrugen.

5.2 LLaVA: Pionier des Visual Instruction Tuning

Liu et al. schlugen mit LLaVA (Large Language and Vision Assistant)[6] einen schlankeren Ansatz vor. LLaVA verwendet eine einfache lineare Projektionsschicht, um die Ausgabe des CLIP Vision Encoders in den Embedding-Raum des Sprachmodells (LLaMA/Vicuna) abzubilden. Die entscheidende Innovation liegt in der Konstruktion der Trainingsdaten: LLaVA nutzte GPT-4, um automatisch 150.000 Visual-Instruction-Tuning-Datenpunkte zu generieren -- darunter Bildbeschreibungen, visuelles Schlussfolgern und komplexe Dialoge in verschiedenen Formaten.

Der Erfolg von LLaVA vermittelte eine wichtige Botschaft: Im multimodalen Bereich koennen hochwertige Instruction-Tuning-Daten moeglicherweise wichtiger sein als komplexes Architekturdesign. Die Folgeversion LLaVA-1.5 erzielte mit nur etwa 1,2 Millionen Datenpunkten auf 11 Benchmark-Tests den Stand der Technik.

5.3 MiniGPT-4: Die Kraft der minimalistischen Architektur

MiniGPT-4[8] verfolgte eine noch extremere Philosophie: Nur eine lineare Projektionsschicht verbindet den Q-Former von BLIP-2 mit dem Vicuna-Sprachmodell, und anschliessend wird mit etwa 3.500 sorgfaeltig kuratierten, hochwertigen Bild-Text-Paaren feinabgestimmt. Das Ergebnis war ueberraschend -- MiniGPT-4 demonstrierte viele Faehigkeiten, die denen von GPT-4V aehneln, darunter detaillierte Bildbeschreibungen, Generierung von Website-Code aus Handskizzen und Erklaerung von Memes. Dies deutet darauf hin, dass das Auftreten multimodaler Faehigkeiten moeglicherweise staerker von der Argumentationsfaehigkeit des Sprachmodells selbst abhaengt und die fuer das Vision-Language-Alignment benoetigte Datenmenge deutlich geringer sein koennte als erwartet.

Fuer Unternehmen liegt die Bedeutung dieser Open-Source-Modelle nicht nur darin, dass sie „kostenlose Alternativen" sind. Sie bieten die Moeglichkeit, auf eigener Hardware bereitzustellen, mit eigenen Daten feinzustimmen und sicherzustellen, dass Daten die Unternehmensfirewall nicht verlassen -- ein unverzichtbares Erfordernis in Branchen mit hoher Sensibilitaet fuer Datensouveraenitaet wie Finanzwesen, Gesundheitswesen und Verteidigung.

6. Unternehmensanwendungen: Praxisbeispiele aus Fertigung, Gesundheitswesen und Einzelhandel

Die technologischen Durchbrueche multimodaler KI werden in konkreten Geschaeftswert umgesetzt. Im Folgenden analysieren wir aus drei fuer Unternehmen hochrelevanten Branchen den Implementierungspfad und die praktischen Vorteile multimodaler KI.

6.1 Fertigung: Intelligente Qualitaetskontrolle

Traditionelle AOI-Systeme (Automated Optical Inspection) basieren auf vordefinierten Regeln und Template-Matching. Jedes Mal, wenn sich Produktspezifikationen aendern oder neue Defekttypen auftreten, muessen die Parameter neu konfiguriert werden. Multimodale KI veraendert diesen Prozess grundlegend: Bediener muessen lediglich Defektmerkmale in natuerlicher Sprache beschreiben (z. B. „unregelmaessige Blasen auf der PCB-Loetstelle"), und das System passt die Erkennungslogik in Echtzeit an.

Eine fortschrittlichere Anwendung ist die Integration multimodaler Modelle in den Qualitaetsberichtserstellungsprozess: Das Modell empfaengt Produktbilder und generiert automatisch strukturierte Qualitaetsberichte mit Defektposition, -typ und Schweregrad und fuehrt einen Abgleich mit der historischen Defektdatenbank durch. In Kernbranchen wie der Halbleiterverpackung, dem Praezisionsmaschinenbau und der Displayherstellung kann dies die Inspektionseffizienz um 30-50 % steigern und gleichzeitig Konsistenzprobleme bei menschlichen Beurteilungen reduzieren.

6.2 Gesundheitswesen: Bildgebungsgestuetzte Diagnostik und Berichterstellung

Die Analyse medizinischer Bildgebung ist eines der vielversprechendsten Anwendungsszenarien fuer multimodale KI. Traditionelle medizinische KI-Modelle koennen in der Regel nur einen einzelnen Bildtyp verarbeiten (z. B. Roentgen oder CT) und geben lediglich Klassifizierungslabels aus. Multimodale Modelle hingegen koennen gleichzeitig Bildinhalte, Patientenakten und Laborergebnisse verstehen und einen vollstaendigen Entwurf eines Bildgebungsbefunds erstellen, den Radiologen ueberpruefen und korrigieren koennen.

Diese Anwendung ist besonders in Gesundheitssystemen mit knappen Personalressourcen und steigenden Untersuchungszahlen wertvoll: Multimodale KI kann als „erster Screening-Assistent" fuer Radiologen fungieren, verdaechtige Anomalien in der grossen Menge normaler Bilder markieren und so die wertvolle Zeit der Aerzte auf die Faelle konzentrieren, die tatsaechlich professionelle Beurteilung erfordern. Allerdings muss der Einsatz von medizinischer KI strikt den regulatorischen Anforderungen fuer medizinische Geraetesoftware (SaMD) entsprechen, um klinische Validierung und Sicherheit zu gewaehrleisten.

6.3 Einzelhandel: Intelligente Kaufberatung und visuelle Suche

Ein Verbraucher macht ein Foto und laedt es hoch, das System erkennt sofort das Produkt und liefert Kauflinks, Kombinationsvorschlaege und Preisvergleiche -- das ist die typische Anwendung multimodaler KI im Einzelhandel. Fuer E-Commerce- und Einzelhandelsunternehmen verkuerzt die multimodale Suchfaehigkeit den Weg des Verbrauchers von „Ich moechte etwas Aehnliches" bis „In den Warenkorb" erheblich.

Tiefergehende Anwendungen finden sich in der Bestandsverwaltung und Filialanalyse: Durch Echtzeitbilder der Verkaufsflaeche, die von Kameras erfasst werden, kann multimodale KI automatisch den Regalauffuellungsstatus, die Ausstellungskonformitaet und Kundenrouten erkennen und natuerlichsprachliche Betriebsempfehlungsberichte generieren. Diese Art von Anwendung kombiniert visuelles Verstaendnis (Regale interpretieren), Textgenerierung (Berichte verfassen) und Datenanalyse (Abgleich mit historischen Verkaufsdaten) als multimodale Faehigkeiten.

7. Multimodales RAG: Retrieval-Augmented Generation mit Vision und Text

RAG (Retrieval-Augmented Generation) hat sich zur Standardarchitektur fuer den Unternehmenseinsatz von LLMs entwickelt. Multimodales RAG erweitert dieses Framework auf den visuellen Bereich: Es werden nicht nur relevante Textpassagen abgerufen, sondern auch relevante Bilder, Diagramme und technische Zeichnungen als Grundlage fuer die Antwortgenerierung herangezogen.

7.1 Multimodale Embeddings und Cross-Modal-Retrieval

Die Grundlage von multimodalem RAG ist der Aufbau eines Cross-Modal-Embedding-Index. Unter Verwendung von CLIP[1] oder aehnlichen Modellen werden Textpassagen und Bilder aus der Unternehmenswissensbasis in Vektoren im selben semantischen Raum kodiert. Wenn ein Benutzer eine Anfrage stellt (ob Text oder Bild), kann das System gleichzeitig die relevantesten Textfragmente und Bilder abrufen und dem multimodalen LLM als Kontext bereitstellen.

Ein Beispiel: Ein Wartungstechniker steht vor einem Geraeteausfall und kann direkt ein Foto machen und hochladen. Das multimodale RAG-System sucht im technischen Handbuch nach den dem Fehlerbild am aehnlichsten Schaubildern und den zugehoerigen Fehlerbehebungsschritten und laesst dann das multimodale LLM aus diesen Informationen eine gezielte Reparaturanleitung generieren. Diese „Bild-basierte Frage-Antwort"-Faehigkeit ist in traditionellen rein textbasierten RAG-Systemen nicht realisierbar.

7.2 Dokumentenverstaendnis: Strukturierte Analyse jenseits von OCR

Ein Grossteil des Unternehmenswissens liegt in PDF-Berichten, Praesentationsfolien, technischen Zeichnungen und anderen „unstrukturierten visuellen Dokumenten" vor. Der traditionelle Ansatz besteht darin, zunaechst mit OCR Text zu extrahieren und dann eine Textsuche durchzufuehren -- dabei gehen jedoch Layoutstruktur, Diagramminformationen und Bild-Text-Korrespondenzen verloren. Der multimodale RAG-Ansatz fuehrt Dokumentseiten direkt als Bilder ein, sodass das Vision-Language-Modell die vollstaendige visuelle Struktur der Seite verstehen kann.

Dies ist besonders relevant fuer Szenarien wie Finanzberichtsanalyse, juristische Vertragspruefung und Patentdokumentrecherche. Ein Diagramm in einem Finanzbericht vermittelt eine Informationsdichte, die den umgebenden Text bei weitem uebersteigt. Multimodales RAG ermoeglicht es dem System, diese Diagramme direkt zu „verstehen", anstatt sich nur auf die durch OCR extrahierten verstreuten Zahlen zu stuetzen.

7.3 Praktische Ueberlegungen zum Aufbau einer multimodalen Wissensbasis

Beim tatsaechlichen Aufbau eines multimodalen RAG-Systems muessen Unternehmen mehrere wichtige Engineering-Entscheidungen treffen: die Indexierungsgranularitaet von Bildern (ganze Seite, Abschnitte oder einzelne Diagramme?), die Wahl des multimodalen Embedding-Modells (CLIP, SigLIP oder eine domaenenspezifisch feinabgestimmte Version?) sowie das Design der Retrieval-Strategie (reine Vektorsuche, hybride Suche oder strukturierte Suche in Kombination mit Knowledge Graphs?). Fuer diese Entscheidungen gibt es keine universelle beste Antwort -- sie muessen auf der Grundlage der spezifischen Datencharakteristiken und Anwendungsszenarien des Unternehmens systematisch evaluiert und optimiert werden.

8. Herausforderungen und Grenzen: Halluzinationen, Sicherheit und Rechenkosten

Die Faehigkeiten multimodaler KI sind beeindruckend, aber Unternehmen muessen bei der Planung des produktiven Einsatzes die aktuellen Einschraenkungen und Risiken nuechtern beruecksichtigen. Blinder Optimismus kann zum Scheitern von Projekten und Vertrauensverlust fuehren, waehrend ein umfassendes Verstaendnis der Grenzen Unternehmen hilft, robustere Bereitstellungsstrategien zu entwerfen.

8.1 Multimodale Halluzinationen (Multimodal Hallucination)

Halluzinationen -- das Modell generiert Inhalte, die plausibel erscheinen, aber nicht mit der Eingabe uebereinstimmen -- sind in multimodalen Szenarien besonders schwerwiegend. Yin et al. weisen in ihrem Ueberblick[7] darauf hin, dass aktuelle Vision-Language-Modelle anfaellig sind fuer „Objekthalluzinationen" (Beschreibung von Objekten, die im Bild nicht vorhanden sind), „Attributhalluzinationen" (fehlerhafte Beschreibung von Farbe, Groesse oder Position von Objekten) und „Beziehungshalluzinationen" (Erfindung raeumlicher oder semantischer Beziehungen zwischen Objekten).

In Unternehmensanwendungen koennen die Folgen solcher Halluzinationen schwerwiegend sein. Stellen Sie sich ein Qualitaetskontrollsystem vor, das einwandfreie Produkte faelschlicherweise als defekt einstuft (Ueberberichterstattung) oder defekte Produkte als einwandfrei durchlaesst (Unterberichterstattung); oder ein medizinisches Bildgebungssystem, das in seinem Befund eine Laesion beschreibt, die im Bild gar nicht vorhanden ist. Diese Szenarien erfordern, dass Unternehmen beim Einsatz multimodaler KI strenge Mensch-Maschine-Kooperations- und Ueberpruefungsprozesse einrichten, anstatt sich vollstaendig auf die Modellausgabe zu verlassen.

8.2 Sicherheit und Adversarial Attacks

Multimodale Modelle fuehren neue Angriffsflaechen ein. Forschungen haben gezeigt, dass Angreifer durch das Einbetten unsichtbarer Stoerungen (Adversarial Perturbations) in Bilder die Modellausgabe manipulieren koennen -- beispielsweise ein Qualitaetskontrollmodell dazu bringen, bestimmte Defekttypen zu ignorieren, oder ein Dokumentenverstaendnissystem dazu veranlassen, wichtige Zahlen falsch zu lesen. Darueber hinaus sind die Prompt-Injection-Risiken bei multimodalen Modellen komplexer: Boesartige Anweisungen koennen in Bildern versteckt werden und so die Sicherheitsmechanismen auf der reinen Textebene umgehen.

Unternehmen muessen beim Einsatz multimodaler KI adversariale Sicherheitsbewertungen in ihre Standardprozesse integrieren, insbesondere bei sicherheitskritischen Anwendungsszenarien. Die Einrichtung von Eingabevalidierungsmechanismen, Ausgabekonsistenzpruefungen und manuellen Ueberpruefungsschritten bildet derzeit die pragmatischste Verteidigungsstrategie.

8.3 Rechenkosten und Bereitstellungsherausforderungen

Der Rechenbedarf multimodaler Modelle ist deutlich hoeher als der reiner Text-LLMs. Ein hochauflosendes Bild kann nach der Tokenisierung Hunderte von Tokens erzeugen, was den Speicherbedarf und die Latenz bei der Inferenz erheblich erhoehen. Fuer Szenarien, die Videoverarbeitung erfordern (im Wesentlichen eine Sequenz einer grossen Anzahl von Bildframes), steigen die Rechenkosten exponentiell.

Unternehmen muessen bei der KI-ROI-Bewertung multimodaler KI die Kosten fuer die GPU-Infrastruktur, die Auswirkungen der Inferenzlatenz auf die Benutzererfahrung sowie die Wartungskosten fuer Modellaktualisierungen beruecksichtigen. Fuer die meisten mittelstaendischen Unternehmen ist eine Hybridstrategie -- hochkomplexe multimodale Aufgaben ueber APIs an Cloud-Dienste auszulagern und latenz- oder datensensitive Aufgaben lokal bereitzustellen -- oft der pragmatischste Einstiegsansatz.

9. Fazit: Die naechsten Schritte fuer multimodale KI

Multimodale KI befindet sich an einem kritischen Wendepunkt vom „technologischen Durchbruch" hin zum „industriellen Einsatz". Rueckblickend auf den roten Faden dieses Artikels: CLIP[1] legte die Grundlage fuer das Vision-Language-Alignment, Flamingo[2] war Pionier des multimodalen Few-Shot-Lernens, GPT-4V[3] und Gemini[4] zeigten die Obergrenze universeller multimodaler Intelligenz, und Open-Source-Modelle wie LLaVA[6] und BLIP-2[5] ebneten den Weg fuer den privaten Unternehmenseinsatz.

Mit Blick auf die Zukunft verdienen mehrere Trends Aufmerksamkeit. Erstens die fortlaufende Erweiterung der Modalitaetsbandbreite: vom bimodalen Bild-Text-Verstaendnis hin zum vollstaendigen multimodalen Verstaendnis von Bild, Text, Audio und Video. PaLM-E[10] hat bereits die Moeglichkeit demonstriert, multimodale Faehigkeiten auf Roboterwahrnehmung und -steuerung auszudehnen. Zweitens Durchbrueche bei der Inferenzeffizienz: Die Rechenkosten aktueller multimodaler Modelle bleiben ein Engpass fuer den groessangelegten Einsatz, waehrend Technologien wie visuelle Token-Komprimierung, dynamische Aufloesung und Sparse Attention sich rasch weiterentwickeln. Drittens multimodale Agenten: Die Kombination multimodaler Verstaendnisfaehigkeiten mit Werkzeugnutzung und Planungsargumentation, die es KI ermoeglicht, in realen visuellen Umgebungen komplexe Aufgaben autonom zu erledigen.

Fuer Unternehmen ist jetzt der beste Zeitpunkt, multimodale KI-Faehigkeiten aufzubauen. Die Technologie ist reif genug, um echten Geschaeftswert zu generieren, aber der Markt befindet sich noch nicht im Verdraengungswettbewerb. Der Schluessel liegt darin, den richtigen Einstiegspunkt zu finden: von einem klar definierten Geschaeftsproblem ausgehen, die passende Modellarchitektur und Bereitstellungsstrategie waehlen und nach erfolgreicher Validierung im kleinen Massstab schrittweise skalieren.

Das Forschungsteam von Meta Intelligence verfolgt kontinuierlich die neuesten Durchbrueche im Bereich multimodaler KI bei Spitzenkonferenzen wie NeurIPS, CVPR und ICLR und uebertraegt Spitzenforschung in praxistaugliche Unternehmensloesungen. Wenn Ihre Organisation die Anwendungsmoeglichkeiten multimodaler KI erkundet, laden wir Sie zu einem vertieften Fachgespraech ein -- die Distanz von der akademischen Forschungsfront bis zum industriellen Einsatz ist moeglicherweise kuerzer als Sie denken.