- Der EU AI Act macht die Erklärbarkeit von „Hochrisiko-KI-Systemen" zur Pflicht — KI-Einsätze in den Bereichen Finanzen, Gesundheitswesen und Justiz, die ihre Entscheidungslogik nicht darlegen können, setzen sich rechtlichen Risiken aus[6]

- SHAP (basierend auf Shapley-Werten) ist derzeit die einzige Feature-Attributionsmethode mit vollständiger mathematischer Axiom-Garantie (lokale Genauigkeit, Fehlen, Konsistenz) und ist auf beliebige Modelle anwendbar[2]

- Grad-CAM macht durch gradientengewichtete Feature-Map-Visualisierung die „Aufmerksamkeitsbereiche" von Bildklassifikationsmodellen auf einen Blick sichtbar — ohne die Modellarchitektur zu ändern oder neu zu trainieren[3]

- Dieser Artikel enthält zwei Google-Colab-Praxisübungen: Textsentiment-Klassifikation × SHAP-Erklärung sowie Bildklassifikation × Grad-CAM + SHAP, die direkt im Browser ausführbar sind

I. Das „Black-Box"-Problem: Die größte Vertrauenshürde bei der KI-Implementierung

Wenn ein Deep-Learning-Modell Ihnen sagt: „Dieser Kreditantrag sollte abgelehnt werden", „Dieses Röntgenbild hat eine 93-prozentige Wahrscheinlichkeit für einen bösartigen Tumor" oder „Dieser Bewerber ist für diese Stelle nicht geeignet" — dann lautet Ihre erste Frage garantiert: Warum?

Das ist das „Black-Box"-Problem der KI. Bei traditionellen Machine-Learning-Modellen (Entscheidungsbäume, lineare Regression) ist die Entscheidungslogik klar nachvollziehbar. Doch die Wechselwirkungen zwischen Millionen oder sogar Milliarden Parametern tiefer neuronaler Netze machen es für Menschen nahezu unmöglich, intuitiv zu verstehen, „was das Modell sieht" und „was es denkt".

Dies ist nicht nur ein technisches, sondern auch ein geschäftliches und rechtliches Problem. Der EU AI Act[6] (2024 offiziell in Kraft getreten) klassifiziert KI-Systeme nach Risikogruppen. Die Kategorie „Hochrisiko" — die Kreditbewertung, medizinische Diagnostik, Strafzumessung und Personalauswahl umfasst — verlangt ausdrücklich Transparenz und Erklärbarkeit. Bei Verstößen drohen Bußgelder von bis zu 3 % des weltweiten Jahresumsatzes.

Die McKinsey-Globalumfrage von 2024[14] zeigt, dass 72 % der Unternehmen generative KI bereits in mindestens einem Geschäftsbereich einsetzen — doch „mangelnde Erklärbarkeit" bleibt eines der größten Bedenken von Führungskräften gegenüber KI-Systemen. Cynthia Rudin fordert in ihrem wegweisenden Artikel in Nature Machine Intelligence[4] sogar direkt: In hochriskanten Entscheidungsszenarien sollten wir aufhören, Black-Box-Modelle zu erklären, und stattdessen von vornherein interpretierbare Modelle verwenden.

Die Realität ist jedoch, dass Deep-Learning-Modelle bei vielen Aufgaben weit besser abschneiden als interpretierbare Modelle. Daher wird die technologische Entwicklung erklärbarer KI (Explainable AI, XAI) — die es uns ermöglicht, die „Black Box zu öffnen", ohne die Leistung zu opfern — zum entscheidenden Puzzlestück für die skalierte KI-Implementierung.

II. XAI-Technologielandschaft: Von Post-hoc-Erklärungen bis zu eingebauter Transparenz

XAI-Technologien lassen sich entlang zweier Dimensionen klassifizieren[7][5]: Post-hoc-Erklärung vs. eingebaute Transparenz (Intrinsic) sowie modellagnostisch vs. modellspezifisch.

| Methode | Kategorie | Anwendungsbereich | Kernprinzip | Vorteile | Einschränkungen |

|---|---|---|---|---|---|

| LIME | Post-hoc / modellagnostisch | Beliebige Modelle | Lokale Perturbation + lineare Approximation | Intuitiv, breit anwendbar | Instabil, Erklärungen variieren durch zufällige Perturbation |

| SHAP | Post-hoc / modellagnostisch | Beliebige Modelle | Axiomatische Allokation mittels Shapley-Werten | Mathematisch garantiert, global + lokal | Hoher Rechenaufwand (exponentielle Komplexität, approximiert) |

| Grad-CAM | Post-hoc / modellspezifisch | Convolutional Neural Networks | Gradientengewichtete Feature Maps | Visuell intuitiv, in Echtzeit | Nur für CNNs, begrenzte Auflösung |

| Integrated Gradients | Post-hoc / modellspezifisch | Differenzierbare Modelle | Pfadintegral der Gradienten entlang einer Baseline | Axiomatisch (Vollständigkeit + Sensitivität) | Baseline-Wahl erforderlich, hohe Rechenkosten |

| Attention-Visualisierung | Eingebaut / modellspezifisch | Transformer-Architektur | Heatmap der Attention-Gewichte | Kein zusätzlicher Rechenaufwand | Attention ≠ Erklärung[12] |

| Saliency Maps | Post-hoc / modellspezifisch | Differenzierbare Modelle | Absolutwerte der Eingabegradienten | Einfach und schnell | Verrauscht, anfällig für Adversarial Attacks |

| Entscheidungsbaum / Regeln | Eingebaute Transparenz | Flache Modelle | Baumförmige Verzweigungslogik | Vollständig transparent | Unzureichende Leistung bei komplexen Aufgaben |

| Lineare Modelle / GAM | Eingebaute Transparenz | Flache Modelle | Direkt ablesbare Feature-Koeffizienten | Vollständig transparent | Kann nichtlineare Interaktionen nicht erfassen |

Doshi-Velez und Kim[8] schlugen 2017 ein dreistufiges Bewertungsframework für Erklärbarkeit vor: Anwendungsebene (Bewertung durch Domänenexperten), Humanebene (Benutzertests mit vereinfachten Aufgaben) und Funktionsebene (Proxy-Metriken ohne menschliche Beteiligung). Verschiedene Szenarien erfordern unterschiedliche Erklärungsintensitäten — medizinische Diagnostik benötigt möglicherweise detaillierte Erklärungen auf Anwendungsebene, während ein Empfehlungssystem sich mit einem Feature-Importance-Ranking auf Funktionsebene begnügen kann.

Zur Vorsicht mahnt die Forschung von Adebayo et al.[12] auf der NeurIPS 2018: Viele Saliency-Map-Methoden erzeugen auch nach Randomisierung der Modellparameter ähnliche Visualisierungen — das bedeutet, sie heben möglicherweise nur strukturelle Merkmale der Eingabedaten hervor, statt die tatsächliche Lernlogik des Modells wiederzugeben. Slack et al.[13] demonstrierten darüber hinaus adversariale Angriffe auf LIME und SHAP: Es lassen sich Klassifikatoren konstruieren, die bei der Erklärung „fair" erscheinen, in der tatsächlichen Entscheidungsfindung jedoch diskriminierend handeln.

Diese Studien zeigen uns: XAI-Werkzeuge sind diagnostische Hilfsmittel, kein Freifahrtschein. Der korrekte Einsatz von XAI erfordert ein Verständnis der Annahmen, Einschränkungen und Anwendungsbereiche jeder Methode.

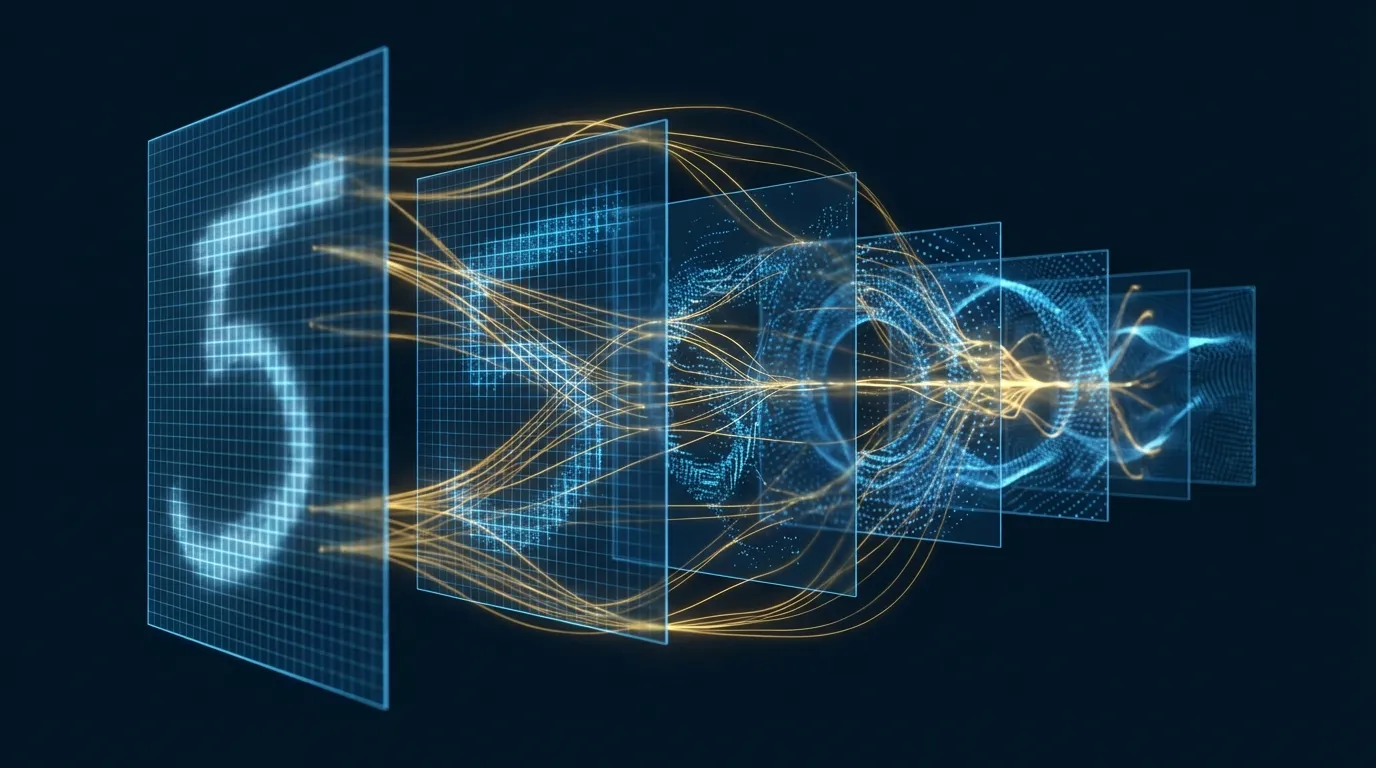

III. Erklärbarkeitstechnologien für Text-KI

NLP-Modelle (Natural Language Processing) — von der Sentimentklassifikation bis zu Frage-Antwort-Systemen — haben bei der Erklärbarkeit einen einzigartigen Vorteil, da sie menschliche Sprache verarbeiten: Wir können direkt auf Wort- oder Satzebene zeigen, welche Textfragmente den größten Einfluss auf die Modellentscheidung haben.

3.1 SHAP for Text

Die Kernidee von SHAP (SHapley Additive exPlanations)[2] stammt aus dem Shapley-Wert der kooperativen Spieltheorie: Das Vorhersageergebnis des Modells wird als „Ertrag" betrachtet, der durch die „Kooperation" aller Features entsteht, und dieser Ertrag wird dann fair auf jedes Feature verteilt. Bei Text ist jedes Token (Wort oder Subwort) ein „Spieler".

Die mathematische Grundlage von SHAP garantiert drei einzigartige axiomatische Eigenschaften:

- Lokale Genauigkeit (Local Accuracy): Die Summe aller SHAP-Werte der Features entspricht dem ursprünglichen Vorhersagewert des Modells

- Fehlen (Missingness): Der SHAP-Wert eines nicht vorhandenen Features ist Null

- Konsistenz (Consistency): Wenn der Marginalbeitrag eines Features in allen Kontexten steigt, muss auch sein SHAP-Wert steigen

Im Textbereich erzeugt SHAP intuitive Visualisierungen: Positiv beitragende Wörter werden rot dargestellt, negativ beitragende blau — so erkennen Sie auf einen Blick, „aufgrund welcher Wörter" das Modell seine Entscheidung getroffen hat.

3.2 LIME for Text

Der Ansatz von LIME (Local Interpretable Model-agnostic Explanations)[1] ist noch intuitiver: Im Umfeld der zu erklärenden Stichprobe werden lokale Perturbationen durchgeführt (zufälliges Entfernen einiger Wörter), die Änderungen in der Modellvorhersage beobachtet und dann ein einfaches lineares Modell verwendet, um dieses lokale Verhalten zu approximieren.

Der Vorteil von LIME ist die Geschwindigkeit und Anwendbarkeit auf jedes Modell. Der Nachteil ist jedoch offensichtlich — da es auf zufälligem Sampling basiert, können zwei LIME-Durchläufe auf denselben Daten unterschiedliche Erklärungen liefern. SHAP hat dieses Problem nicht, da die Lösung der Shapley-Werte eindeutig ist.

3.3 Attention-Visualisierung

Die Transformer-Architektur[11] erzeugt durch ihren Self-Attention-Mechanismus natürlicherweise Attention Weights — den „Aufmerksamkeitsgrad" jedes Tokens gegenüber allen anderen Tokens. Diese Gewichte lassen sich direkt als Heatmap visualisieren, die zeigt, „welche anderen Wörter das Modell bei der Verarbeitung eines bestimmten Wortes betrachtet hat".

Allerdings ist Vorsicht geboten: Attention Weights ≠ Feature Importance. Die Sanity-Check-Studie von Adebayo et al.[12] sowie zahlreiche Folgestudien zeigen, dass die Attention-Verteilung manchmal eher die statistische Struktur der Sprache widerspiegelt (z. B. erhalten hochfrequente Wörter stets mehr Attention) als die tatsächliche „Schlussfolgerungsgrundlage" des Modells. Daher eignet sich die Attention-Visualisierung als exploratives Hilfsmittel, sollte aber nicht als Grundlage für formale Erklärbarkeitsberichte dienen.

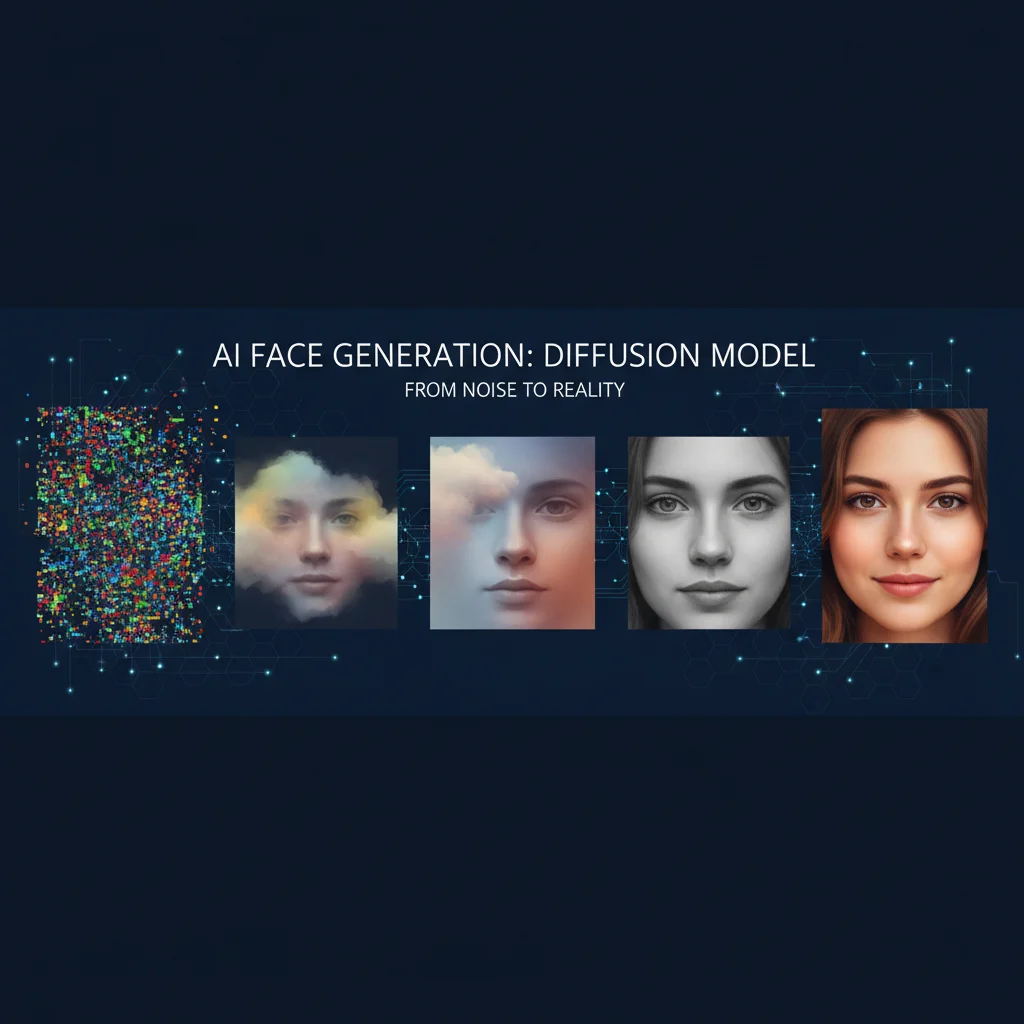

IV. Erklärbarkeitstechnologien für Bild-KI

Die Erklärbarkeitsherausforderung bei Bildmodellen liegt darin, dass die Eingabe eine Pixelmatrix ist und einzelne Pixel kaum semantische Bedeutung haben. Die zentrale Frage der Bild-XAI lautet daher: Welchen Bereich des Bildes „betrachtet" das Modell eigentlich?

4.1 Grad-CAM: Gradientengewichtete Klassenaktivierungskarten

Grad-CAM[3] (Gradient-weighted Class Activation Mapping) ist die derzeit am weitesten verbreitete CNN-Visualisierungsmethode und eine Verallgemeinerung von CAM[15]. Die Kernschritte sind äußerst prägnant:

- Vorwärtsdurchlauf: Erfassung der Feature Maps der Ziel-Faltungsschicht

- Rückwärtsdurchlauf: Berechnung der Gradienten der Zielklasse bis zu dieser Faltungsschicht

- Für jeden Feature-Map-Kanal wird der globale Durchschnittswert seiner Gradienten als Gewicht verwendet

- Gewichtete Summation aller Feature Maps, anschließend ReLU zur Erzeugung der Heatmap

Das Ergebnis ist eine Heatmap in der Größe des Eingabebildes, wobei hervorgehobene Bereiche die „am meisten beachteten" Positionen des Modells anzeigen. Der Vorteil von Grad-CAM liegt darin, dass weder die Modellstruktur geändert noch ein erneutes Training durchgeführt werden muss, und die Rechenkosten äußerst gering sind (ein einziger Rückwärtsdurchlauf genügt). Die Nachfolgeversion Grad-CAM++[16] verbesserte darüber hinaus die Lokalisierungsgenauigkeit in Multi-Object-Szenarien.

4.2 SHAP for Vision

SHAP lässt sich ebenso auf Bildmodelle anwenden, erfordert jedoch die Gruppierung von Pixeln zu „Superpixeln" — semantisch sinnvollen Bereichen. Durch Partition SHAP oder Kernel SHAP lässt sich der Beitragswert jedes Superpixel-Bereichs zum Klassifikationsergebnis berechnen.

Im Vergleich zu Grad-CAM sind die Rechenkosten von SHAP for Vision deutlich höher (es werden zahlreiche Perturbations-Samples benötigt), dafür liefert es eine präzisere quantitative Attribution — es zeigt nicht nur, „wo das Modell hinschaut", sondern auch die Beitragsrichtung (positiv oder negativ) und die Magnitude jedes Bereichs.

4.3 Saliency Maps und Integrated Gradients

Saliency Maps[9] sind die früheste Methode der Gradientenvisualisierung: Die Gradienten der Ausgabe bezüglich jedes Eingabepixels werden direkt berechnet und ihre Absolutwerte als „Salienz" verwendet. Das Konzept ist einfach, aber in der Praxis sehr verrauscht.

Integrated Gradients[10] lösen dieses Problem durch Pfadintegration der Gradienten von einer Baseline (typischerweise ein komplett schwarzes Bild) bis zur tatsächlichen Eingabe. Die Methode erfüllt zwei wichtige Axiome: Vollständigkeit (die Summe der Attributionen aller Pixel entspricht der Differenz zwischen Modellausgabe und Baseline-Ausgabe) und Sensitivität (wenn die Änderung eines Pixels das Vorhersageergebnis verändert, muss sein Attributionswert ungleich Null sein).

V. Hands-on Lab 1: Textsentiment-Klassifikation × SHAP-Erklärung (Google Colab)

Dieses Lab verwendet ein vortrainiertes Sentimentklassifikationsmodell von HuggingFace Transformers in Kombination mit dem SHAP-Paket, um die Vorhersage des Modells für jeden Text in den Beitrag jedes einzelnen Wortes „aufzuschlüsseln".

Google Colab öffnen (CPU genügt), neues Notebook erstellen und nacheinander folgenden Code einfügen:

5.1 Umgebungsinstallation

# ★ Erforderliche Pakete installieren ★

!pip install transformers shap -q

5.2 Modell laden und SHAP Explainer erstellen

import shap

from transformers import pipeline

# ★ Vortrainierte HuggingFace-Sentimentklassifikations-Pipeline laden ★

# Verwendung von distilbert-base-uncased-finetuned-sst-2-english (leichtgewichtig und bewährt)

sentiment = pipeline(

"sentiment-analysis",

model="distilbert-base-uncased-finetuned-sst-2-english",

top_k=None # Wahrscheinlichkeiten aller Klassen zurückgeben

)

# Modell testen

test_texts = [

"This movie was absolutely fantastic! The acting was superb.",

"Terrible service, the food was cold and the waiter was rude.",

"The product is okay, nothing special but not bad either.",

]

for text in test_texts:

result = sentiment(text)

top = max(result[0], key=lambda x: x['score'])

print(f" [{top['label']} {top['score']:.3f}] {text}")

5.3 SHAP-Texterklärung und Visualisierung

# ★ SHAP Explainer erstellen ★

# masker = shap.maskers.Text() verwendet Token-Masking-Strategie für Perturbation

explainer = shap.Explainer(sentiment, masker=shap.maskers.Text())

# ★ SHAP-Werte berechnen ★

shap_values = explainer(test_texts)

# ★ Visualisierung: Text-Heatmap ★

# Rot = positiver Beitrag (treibt zur Vorhersage hin), Blau = negativer Beitrag (treibt von der Vorhersage weg)

print("SHAP Text Plot — Beitrag jedes Wortes zur Modellvorhersage")

shap.plots.text(shap_values)

5.4 Detailanalyse einzelner Datenpunkte: Waterfall-Diagramm

# ★ Waterfall-Diagramm: Kumulative Aufschlüsselung der Vorhersage Wort für Wort ★

# Am Beispiel des ersten Satzes (positive Stimmung)

print("Waterfall Plot — Wort-für-Wort-Beitragsaufschlüsselung des ersten Satzes")

shap.plots.waterfall(shap_values[0, :, "POSITIVE"])

5.5 Eigene Texte analysieren

# ★ Probieren Sie Ihre eigenen Texte aus ★

custom_texts = [

"The AI model predicted the patient had cancer, but the doctor disagreed.",

"I love how this phone breaks after just two weeks of use.",

"Despite the high price, the quality exceeded all my expectations.",

]

custom_shap = explainer(custom_texts)

shap.plots.text(custom_shap)

# ★ Beobachtungsschwerpunkte ★

# 1. Ironischer Satz (zweiter Satz): Kann das Modell ihn korrekt verarbeiten? SHAP zeigt, welche Wörter das Modell irregeführt haben

# 2. Kontrastsatz (dritter Satz): Stimmt die Beitragsrichtung von „despite" und „exceeded" mit der Intuition überein?

# 3. Domänenspezifisches Vokabular (erster Satz): SHAP-Wertverteilung medizinischer Begriffe

5.6 Bar Plot: Globale Feature Importance über alle Datenpunkte

# ★ Globale Feature Importance: Welche Wörter haben über mehrere Datenpunkte den größten Einfluss ★

all_texts = test_texts + custom_texts

all_shap = explainer(all_texts)

print("Bar Plot — Globales Token-Importance-Ranking über alle Datenpunkte")

shap.plots.bar(all_shap[:, :, "POSITIVE"].mean(0))

VI. Hands-on Lab 2: Bildklassifikation × Grad-CAM + SHAP (Google Colab)

Dieses Lab verwendet ein vortrainiertes ResNet-50 aus torchvision, kombiniert mit dem pytorch-grad-cam-Paket zur Erzeugung von Grad-CAM-Heatmaps, sowie den SHAP Partition Explainer für quantitative Attributionsanalyse.

Google Colab öffnen (CPU genügt, GPU ist schneller), neues Notebook erstellen und nacheinander folgenden Code einfügen:

6.1 Umgebungsinstallation

# ★ Erforderliche Pakete installieren ★

!pip install pytorch-grad-cam shap -q

6.2 Modell laden und Testbilder vorbereiten

import torch

import torch.nn.functional as F

import torchvision.models as models

import torchvision.transforms as transforms

import numpy as np

from PIL import Image

import urllib.request

import matplotlib.pyplot as plt

# ★ Vortrainiertes ResNet-50 laden ★

model = models.resnet50(weights='IMAGENET1K_V1').eval()

# ImageNet-Standard-Vorverarbeitung

preprocess = transforms.Compose([

transforms.Resize(256),

transforms.CenterCrop(224),

transforms.ToTensor(),

transforms.Normalize(

mean=[0.485, 0.456, 0.406],

std=[0.229, 0.224, 0.225]

),

])

# ★ Testbild herunterladen (ImageNet-Beispiel) ★

url = "https://upload.wikimedia.org/wikipedia/commons/thumb/4/4d/Cat_November_2010-1a.jpg/1200px-Cat_November_2010-1a.jpg"

urllib.request.urlretrieve(url, "test_cat.jpg")

img = Image.open("test_cat.jpg").convert("RGB")

# Vorverarbeitung

input_tensor = preprocess(img).unsqueeze(0) # [1, 3, 224, 224]

# Inferenz

with torch.no_grad():

output = model(input_tensor)

probs = F.softmax(output, dim=1)

top5 = torch.topk(probs, 5)

# ImageNet-Klassennamen laden

url_labels = "https://raw.githubusercontent.com/pytorch/hub/master/imagenet_classes.txt"

urllib.request.urlretrieve(url_labels, "imagenet_classes.txt")

with open("imagenet_classes.txt") as f:

categories = [s.strip() for s in f.readlines()]

print("Top-5-Vorhersageergebnisse:")

for i in range(5):

idx = top5.indices[0][i].item()

prob = top5.values[0][i].item()

print(f" {i+1}. {categories[idx]} ({prob:.2%})")

plt.figure(figsize=(6, 6))

plt.imshow(img)

plt.title(f"Predicted: {categories[top5.indices[0][0].item()]}")

plt.axis("off")

plt.show()

6.3 Grad-CAM-Visualisierung

from pytorch_grad_cam import GradCAM, GradCAMPlusPlus

from pytorch_grad_cam.utils.image import show_cam_on_image

from pytorch_grad_cam.utils.model_targets import ClassifierOutputTarget

# ★ Ziel-Faltungsschicht auswählen (letzter Bottleneck von ResNet-50) ★

target_layers = [model.layer4[-1]]

# ★ Grad-CAM ★

cam = GradCAM(model=model, target_layers=target_layers)

# Top-1-Vorhersageklasse als Ziel

targets = [ClassifierOutputTarget(top5.indices[0][0].item())]

grayscale_cam = cam(input_tensor=input_tensor, targets=targets)

grayscale_cam = grayscale_cam[0, :] # [224, 224]

# Originalbild in NumPy konvertieren (Wertebereich 0-1)

img_resized = img.resize((224, 224))

rgb_img = np.array(img_resized).astype(np.float32) / 255.0

# ★ Heatmap auf Originalbild überlagern ★

visualization = show_cam_on_image(rgb_img, grayscale_cam, use_rgb=True)

# ★ Grad-CAM++ zum Vergleich ★

cam_pp = GradCAMPlusPlus(model=model, target_layers=target_layers)

grayscale_cam_pp = cam_pp(input_tensor=input_tensor, targets=targets)[0, :]

visualization_pp = show_cam_on_image(rgb_img, grayscale_cam_pp, use_rgb=True)

# Visueller Vergleich

fig, axes = plt.subplots(1, 3, figsize=(18, 6))

axes[0].imshow(img_resized)

axes[0].set_title("Original Image", fontsize=14)

axes[0].axis("off")

axes[1].imshow(visualization)

axes[1].set_title("Grad-CAM", fontsize=14)

axes[1].axis("off")

axes[2].imshow(visualization_pp)

axes[2].set_title("Grad-CAM++", fontsize=14)

axes[2].axis("off")

plt.suptitle(f"Model Focus: {categories[top5.indices[0][0].item()]}", fontsize=16)

plt.tight_layout()

plt.show()

6.4 Grad-CAM-Vergleich mehrerer Klassen

# ★ Vergleich der Grad-CAM-Heatmaps für die Top-3-Klassen ★

fig, axes = plt.subplots(1, 3, figsize=(18, 6))

for i in range(3):

class_idx = top5.indices[0][i].item()

class_name = categories[class_idx]

class_prob = top5.values[0][i].item()

targets_i = [ClassifierOutputTarget(class_idx)]

cam_i = cam(input_tensor=input_tensor, targets=targets_i)[0, :]

vis_i = show_cam_on_image(rgb_img, cam_i, use_rgb=True)

axes[i].imshow(vis_i)

axes[i].set_title(f"{class_name}\n({class_prob:.2%})", fontsize=13)

axes[i].axis("off")

plt.suptitle("Grad-CAM for Top-3 Predictions", fontsize=16)

plt.tight_layout()

plt.show()

# ★ Beobachtungsschwerpunkte ★

# Fokussieren die Grad-CAM-Heatmaps verschiedener Klassen auf unterschiedliche Bildbereiche?

# Das zeigt, auf welche Regionen das Modell bei verschiedenen Klassen „achtet"

6.5 SHAP for Vision: Quantitative Pixel-Attribution

import shap

# ★ Wrapper-Funktion für die Bildklassifikation erstellen ★

def predict_fn(images):

"""Empfängt NumPy-Array [N, 224, 224, 3], gibt Wahrscheinlichkeiten der Top-5-Klassen zurück"""

batch = torch.stack([

preprocess(Image.fromarray((img * 255).astype(np.uint8)))

for img in images

])

with torch.no_grad():

output = model(batch)

probs = F.softmax(output, dim=1)

# Wahrscheinlichkeit der Top-1-Klasse zurückgeben

top_class = top5.indices[0][0].item()

return probs[:, top_class].numpy()

# ★ Partition Explainer verwenden (besser geeignet für Bilder als Kernel SHAP) ★

masker = shap.maskers.Image("inpaint_telea", (224, 224, 3))

explainer = shap.Explainer(predict_fn, masker, output_names=[categories[top5.indices[0][0].item()]])

# ★ SHAP-Werte berechnen (max_evals steuert Rechenaufwand vs. Genauigkeit) ★

img_numpy = np.array(img_resized).astype(np.float32) / 255.0

shap_values = explainer(

np.expand_dims(img_numpy, axis=0),

max_evals=500,

batch_size=50

)

# ★ Visualisierung: Pixel-Ebene SHAP-Attribution ★

shap.image_plot(shap_values)

# ★ Beobachtungsschwerpunkte ★

# Rote Bereiche = positiver Beitrag (unterstützen die vorhergesagte Klasse)

# Blaue Bereiche = negativer Beitrag (sprechen gegen die vorhergesagte Klasse)

# Vergleichen Sie, ob die Fokusbereiche von SHAP und Grad-CAM übereinstimmen

6.6 Grad-CAM vs. SHAP — Direkter Vergleich

# ★ Abschließender Vergleich: Gemeinsamkeiten und Unterschiede beider Methoden ★

fig, axes = plt.subplots(1, 3, figsize=(18, 6))

# Originalbild

axes[0].imshow(img_resized)

axes[0].set_title("Original", fontsize=14)

axes[0].axis("off")

# Grad-CAM

axes[1].imshow(visualization)

axes[1].set_title("Grad-CAM\n(gradient-based, fast)", fontsize=13)

axes[1].axis("off")

# SHAP (SHAP-Werte in Heatmap umwandeln)

shap_img = shap_values.values[0, :, :, :, 0] # Erste Ausgabe

shap_abs = np.abs(shap_img).sum(axis=-1) # RGB-Kanäle zusammenführen

shap_norm = shap_abs / shap_abs.max() # Auf 0-1 normalisieren

axes[2].imshow(img_resized)

axes[2].imshow(shap_norm, cmap='jet', alpha=0.5)

axes[2].set_title("SHAP\n(game-theoretic, precise)", fontsize=13)

axes[2].axis("off")

plt.suptitle(f"Explainability Comparison: {categories[top5.indices[0][0].item()]}", fontsize=16)

plt.tight_layout()

plt.show()

print("\n【Zusammenfassung des Vergleichs】")

print(" Grad-CAM: Schnell (Millisekundenbereich), geeignet für Echtzeit-Visualisierung; Auflösung jedoch begrenzt durch Feature-Map-Größe")

print(" SHAP: Mathematisch garantiert, liefert quantitative Attribution; Rechenkosten jedoch hoch (Minutenbereich)")

print(" Praxisempfehlung: Erst mit Grad-CAM schnell lokalisieren → dann mit SHAP vertiefte Analyse durchführen")

VII. Entscheidungsframework: Wie Unternehmen die richtige XAI-Methode wählen

Angesichts von mehr als einem Dutzend XAI-Technologien benötigen Unternehmen ein pragmatisches Entscheidungsframework. Die folgende Tabelle bietet Orientierung entlang von vier Schlüsseldimensionen — Compliance-Anforderungen, Modelltyp, Erklärungszielgruppe und Rechenbudget:

| Szenario | Empfohlene Methode | Begründung |

|---|---|---|

| Kreditgenehmigung im Finanzbereich (hohe Compliance) | SHAP + eingebautes interpretierbares Modell | SHAP bietet axiomatische Garantien; bei Anwendbarkeit des EU AI Act sind GAM / interpretierbare Entscheidungsbäume in Betracht zu ziehen |

| Medizinische Bilddiagnostik | Grad-CAM + SHAP Image | Grad-CAM liefert visuelles Echtzeit-Feedback; SHAP liefert quantitative Evidenz zur ärztlichen Überprüfung |

| NLP-Sentimentanalyse / Kundenservice-Klassifikation | SHAP Text | Attribution auf Wortebene ist intuitiv verständlich und mathematisch garantiert |

| Empfehlungssystem (geringe Compliance) | LIME oder Attention | Geschwindigkeit hat Priorität — LIME eignet sich für Rapid Prototyping; Attention verursacht keine zusätzlichen Kosten |

| Wahrnehmungsmodul für autonomes Fahren | Grad-CAM + Integrated Gradients | Pixelgenaue Präzision erforderlich; die axiomatische Natur von IG eignet sich für sicherheitskritische Szenarien |

| Compliance-Berichte / Modell-Audits | SHAP (global + lokal) | Globales Importance-Ranking + Einzelfallerklärung erfüllen die doppelten Anforderungen der Aufsichtsbehörden |

Kernprinzip: Je höher die Compliance-Anforderungen eines Szenarios, desto eher sollten Methoden mit mathematischer Garantie gewählt werden (SHAP > LIME > Attention); je enger das Rechenbudget, desto eher sollten leichtgewichtige Methoden gewählt werden (Grad-CAM > LIME > SHAP).

VIII. Von Compliance zum Wettbewerbsvorteil: Der strategische Wert von XAI

Erklärbarkeit ist nicht nur ein Compliance-Kostenfaktor — sie ist ein Wettbewerbsvorteilsverstärker für die Unternehmens-KI.

- Beschleunigte Modelliteration: Wenn Sie sehen können, „warum das Modell Fehler macht", steigt die Debugging-Effizienz um ein Vielfaches. SHAP-Werte können die Verbesserungsrichtung des Feature Engineering präzise identifizieren; Grad-CAM kann Annotations-Bias im Datensatz aufdecken (z. B. wenn das Modell stets den Hintergrund statt des Hauptobjekts betrachtet)

- Vertrauen bei Stakeholdern aufbauen: Dem Vorstand zu zeigen, „das Modell hat diese Entscheidung aufgrund dieser drei Faktoren getroffen", ist überzeugender als eine einzelne AUC-Kennzahl. Die McKinsey-Umfrage[14] zeigt, dass das Vertrauen von Führungskräften in KI direkt das KI-Investitionsvolumen der Organisation beeinflusst

- PR-Risiken abwehren: Wenn ein KI-System kontroverse Entscheidungen trifft, können Unternehmen mit Erklärbarkeitsberichten proaktiv Transparenz schaffen, statt reaktiv auf Medienanfragen zu reagieren

- EU AI Act-Anforderungen erfüllen: Die 2024 in Kraft getretene Verordnung[6] verlangt von Betreibern hochriskanter KI-Systeme, die Entscheidungslogik gegenüber Nutzern erklären zu können. Unternehmen, die frühzeitig XAI-Kompetenzen aufbauen, vermeiden künftige Compliance-Nachholkosten

- Datenqualitäts-Feedbackschleife: XAI erklärt nicht nur das Modell, sondern deckt auch Datenprobleme auf. Wenn SHAP einem irrelevanten Feature (wie einer Kunden-ID) hohe Wichtigkeit zuweist, deutet das in der Regel auf Data Leakage hin — einer der am schwierigsten zu entdeckenden Bugs in traditionellen ML-Pipelines

IX. Fazit und Ausblick

Erklärbares maschinelles Lernen steht an einem Wendepunkt — vom „akademischen Forschungsgegenstand" zum „Unternehmensstandard". Die Pflichtanforderungen des EU AI Act, der Compliance-Druck der Finanzregulierung und die klinischen Validierungsanforderungen medizinischer KI — all diese externen Kräfte beschleunigen die Industrialisierung der XAI-Technologie.

Auf technologischer Ebene zeichnen sich mehrere bemerkenswerte Trends ab:

- Erklärbarkeit von LLMs: Mit der Verbreitung großer Sprachmodelle wie GPT-4 und Claude wird das Verständnis der „Reasoning-Prozesse" dieser Modelle zur neuen Forschungsfront. Mechanistic Interpretability versucht, die internen Repräsentationen von LLMs auf Neuronenebene zu verstehen

- Konzeptbasierte Erklärungen: Von „welches Pixel ist wichtig" hin zu „welches Konzept ist wichtig" — etwa dass das Modell eine Katze erkennt, weil es „spitze Ohren" und „Schnurrhaare" identifiziert, und nicht aufgrund bestimmter Pixelwerte

- Echtzeit-Erklärungen: XAI von einem Offline-Analysewerkzeug in einen integralen Bestandteil der Echtzeit-Inferenz-Pipeline verwandeln, sodass jede Vorhersage mit einer Erklärung versehen wird

- Integration kausaler Inferenz: Von korrelativer Attribution (SHAP, LIME) hin zu kausaler Attribution, um kontrafaktische Fragen zu beantworten: „Was würde sich an der Vorhersage ändern, wenn dieses Feature anders wäre?"

Der wichtigste Standpunkt — den auch Rudin[4] wiederholt betont — ist jedoch: Erklärbarkeit sollte nicht als nachträgliches Reparaturwerkzeug dienen, sondern als Ausgangspunkt des KI-Systemdesigns. In hochriskanten Szenarien ist es besser, von Anfang an ein leistungsfähiges und von Natur aus interpretierbares Modell zu wählen, als nachträglich SHAP auf ein 100-schichtiges tiefes Netz anzuwenden.

Wenn Ihr Team die Erklärbarkeitsstrategie für KI-Systeme evaluiert oder XAI-Pipelines für bestimmte Bereiche (Finanzen, Gesundheitswesen, Fertigung) aufbauen muss, laden wir Sie herzlich zu einem vertieften Technologiegespräch ein. Das Forschungsteam von Meta Intelligence kann Sie auf der gesamten Reise begleiten — von der Technologieauswahl über die Konzeptvalidierung bis zum Compliance-Bericht.