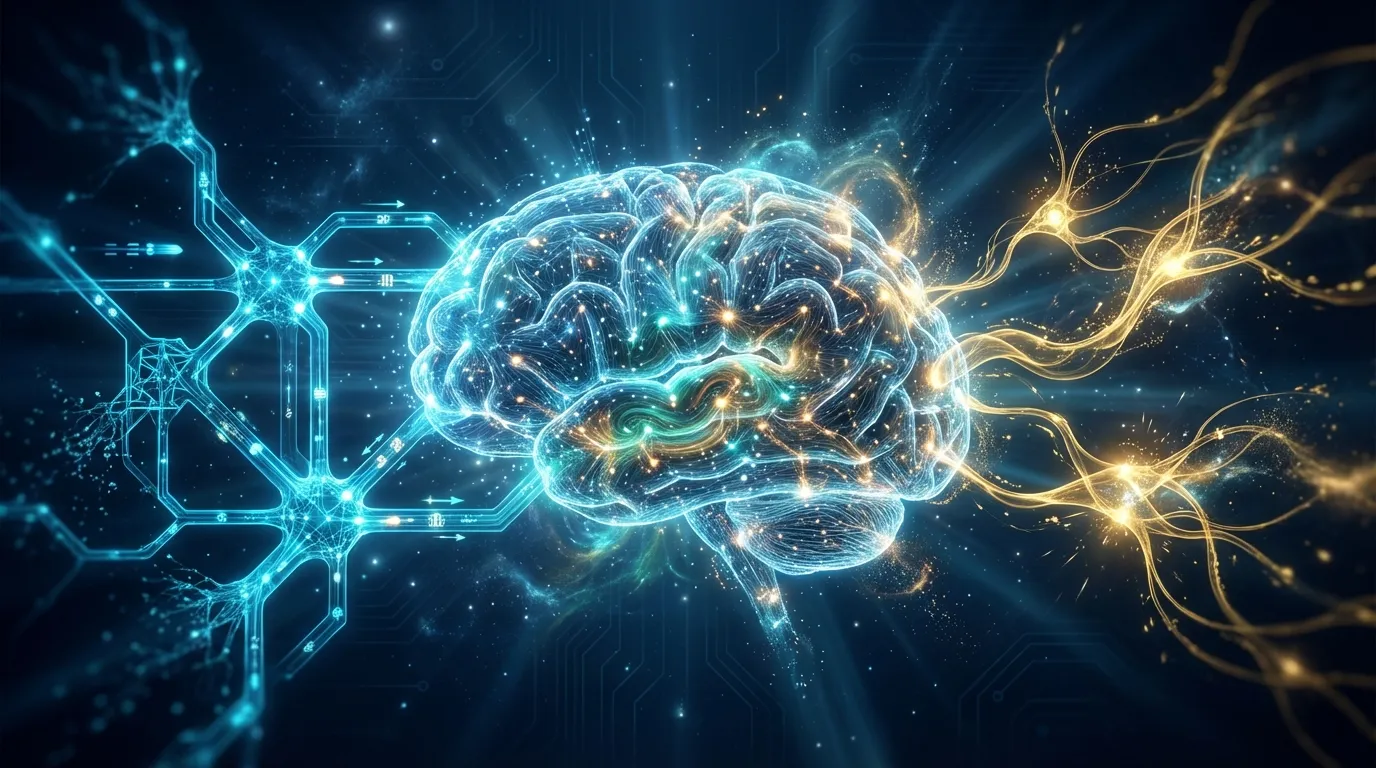

- 自己教師あり学習(SSL)はラベルなしデータから自動的に監督信号を構築し、人手アノテーションのスケールボトルネックを突破する——BERT[1]のマスク言語モデルとMAE[2]のマスク画像復元が2つの代表的パラダイムである

- SSL手法は生成的(MLM、MAE)、対照的(SimCLR[4]、MoCo)、自己蒸留(DINO[3]、BYOL[10])に分類でき——いずれもNLPとCVの両方でブレークスルーを達成

- 基盤モデル[13]のコアは「大規模自己教師あり事前学習 + 下流タスクのファインチューニング」——BERT、GPT[5]、ViT[9]などのモデルが現代AIのインフラストラクチャとなった

- 本記事にはGoogle Colab実践ラボ2本を収録:BERT MLM予測と感情分類ファインチューニング、およびMAE画像マスク復元の可視化——いずれもブラウザで直接実行可能

1. アノテーションのボトルネック:なぜ自己教師あり学習がAIスケーリングの鍵なのか

ディープラーニングの成功は大量の高品質ラベル付きデータに依存しているが、人手アノテーションは根本的なスケールボトルネックに直面している。ImageNetの1400万枚のラベル付き画像には25,000人年以上のアノテーション作業を要し、医療画像の専門家アノテーションコストは1画像あたり数十ドルに達し得る。数十億のウェブページのテキストと画像がある中で、アノテーションは最大の制約要因となっている。

自己教師あり学習(SSL)は突破口を提供する:データ自体の構造から自動的に監督信号を構築し、人手アノテーションなしでモデルが意味のある表現を学習できるようにする。そのコア哲学は——

教師あり学習: 入力 x → 人手ラベル y → f(x) ≈ y を学習

自己教師あり学習: 入力 x → 擬似ラベル ŷ を自動生成(xの構造から抽出) → f(x̃) ≈ ŷ を学習

典型的な「擬似ラベル」戦略:

テキスト: 一部のトークンをマスクし、マスクされたトークンを予測(BERT MLM)

画像: 一部のパッチをマスクし、マスクされたピクセルを復元(MAE)

音声: 一部のタイムステップをマスクし、マスクされた音声表現を予測(wav2vec 2.0)

汎用: データの2つの拡張ビューが類似した表現にマッピングされるべき(対照学習)

SSLの力はインターネット上の事実上無限のラベルなしデータを解放することにある。BERT[1]はBooksCorpus + 英語Wikipedia(33億トークン)で事前学習され、GPT-3[8]は3000億トークンの混合コーパスを使用した。これほどのスケールのデータは人手アノテーションでは取得不可能だが、自己教師あり学習によりモデルはそこから豊富な言語と世界知識を獲得できる。

2. SSLの全体像:プレテキストタスクから対照学習まで

自己教師あり学習の発展は、手設計のプレテキストタスクから汎用フレームワークへと進化してきた[12]。現在の主要手法の分類は以下の通りである:

| カテゴリ | コアアイデア | NLP代表例 | CV代表例 | 利点 |

|---|---|---|---|---|

| 生成的 | 入力をマスクまたは破損し、元データを復元 | BERT MLM[1]、GPT CLM[5] | MAE[2]、BEiT[14] | 直感的、安定した学習、細粒度の表現 |

| 対照的 | 正例ペアを近づけ、負例ペアを遠ざける | — | SimCLR[4]、MoCo | 意味レベルの表現、高い転移能力 |

| 自己蒸留 | 生徒ネットワークが教師ネットワークの出力を予測 | — | DINO[3]、BYOL[10] | 負例不要、意味が自動的に創発 |

| 脱相関 | 特徴次元間の独立性を最大化 | — | Barlow Twins[17] | 概念的にシンプル、モード崩壊を回避 |

| 弁別的 | 実トークンと置換トークンを区別 | ELECTRA[16] | — | 高いサンプル効率、全位置が学習 |

注目すべきは、最新の手法が複数のパラダイムを融合し始めていることである。DINOv2[15]はDINOの自己蒸留目的関数とiBOTのマスク予測目的関数を同時に使用し、BEiT[14]はマスク予測と離散トークン化を組み合わせている。このハイブリッドトレンドは手法カテゴリ間の境界を曖昧にしつつある。

3. テキストAIにおける自己教師あり革命:BERTとマスク言語モデル

2018年、Devlinら[1]はBERT(Bidirectional Encoder Representations from Transformerアーキテクチャs)を提案し、NLP研究のパラダイムを根本的に変えた。そのコアイノベーションは2つの自己教師ありタスクであった:

マスク言語モデル(MLM)

入力系列のトークンの15%をランダムにマスクし、モデルにマスクされたトークンを予測させる。これによりモデルは双方向コンテキストの理解を強いられる——GPTの単方向自己回帰アプローチ[5]とは異なり、BERTは左右両方の情報を活用する:

入力: The cat [MASK] on the [MASK]

目標: [MASK] → "sat", "mat" を予測

BERTのマスキング戦略(事前学習とファインチューニング間のミスマッチを回避するため):

選択された15%のトークンのうち:

80% → [MASK]に置換 例:sat → [MASK]

10% → ランダムトークンに置換 例:sat → dog

10% → 変更なし 例:sat → sat

MLM目的関数:

L_MLM = -E[Σ_{i∈masked} log P(x_i | x_\masked)]

BERTアーキテクチャ:

BERT-Base: L=12, H=768, A=12, Params=110M

BERT-Large: L=24, H=1024, A=16, Params=340M

ここで L=Transformer層数, H=隠れ次元, A=アテンションヘッド数

次文予測(NSP)

文ペア(A, B)が与えられ、BがAの次の文であるかを予測する。このタスクは文間関係の理解を助けることを目的としている。しかし、後続の研究[6]ではNSPの有効性は限定的であることが判明し、RoBERTaはNSPを除去することでむしろ良い結果を達成した。

事前学習→ファインチューニングのパラダイム

BERTは「事前学習 + ファインチューニング」の2段階パラダイムを確立し、基盤モデル[13]のプロトタイプとなった:

フェーズ1:自己教師あり事前学習

大規模ラベルなしコーパス → MLM + NSP → 汎用言語表現

フェーズ2:教師ありファインチューニング

タスク固有の分類ヘッドを追加 → 少量のラベル付きデータでファインチューニング

テキスト分類: [CLS]表現 → 線形 → softmax

固有表現認識: 各トークン表現 → 線形 → BIOタグ

質問応答: 各トークン表現 → 開始/終了位置を予測

文類似度: [CLS]表現 → コサイン類似度

BERTは11のNLPタスクで新SOTAを達成、

平均2-7ポイントの改善でNLP事前学習時代を開始

BERTの後継者たちは事前学習戦略の最適化を継続した:RoBERTa[6]はNSPを除去し動的マスキングとより多くのデータを使用、ELECTRA[16]はMLMを「置換トークン検出」に置き換え、モデルが全位置から学習できるように(15%だけでなく)し、学習効率を大幅に改善した。

4. 画像AIにおける自己教師ありのブレークスルー:MAEとDINO

NLPでのSSLの大成功は、CVドメインでの急速な追随を促した。Vision Transformer(ViT)[9]が統一的なアーキテクチャ基盤を提供した後、CV自己教師あり学習では2つのアプローチが際立った。

Masked Autoencoder(MAE):マスキングから学ぶ

Heら[2]はMAEを提案し、BERTのマスク予測コンセプトを視覚ドメインにエレガントに移植した。重要な洞察は、画像は言語よりはるかに高い情報冗長性を持つため、意味のあるチャレンジを作るには極めて高いマスキング率(75%)が必要であるということである:

MAEアーキテクチャ:

画像 → 16×16パッチに分割 → 75%をランダムにマスク → 可視パッチのみをエンコード

↓

エンコーダー(ViT):25%の可視パッチのみ処理(計算量を大幅に削減)

↓

デコーダー(軽量Transformer):可視パッチのエンコーディング + マスクトークン → ピクセルを復元

↓

損失:MSE(復元ピクセル, 元ピクセル) マスク位置のみで計算

主要な設計選択:

1. 非対称アーキテクチャ:重いエンコーダー + 軽量デコーダー(デコーダーは事前学習のみに使用)

2. 可視パッチのみエンコード:75%マスキング = 4倍の計算量削減

3. ピクセルレベル復元:追加のトークナイザー不要(BEiTと比較して)

4. ランダムマスキング:各学習イテレーションで異なるマスキングパターンを観察

MAEは純粋な自己教師あり事前学習でImageNet-1KにおいてTop-1精度87.8%を達成(ViT-Huge)し、従来の教師あり学習のベースラインを上回った。さらに重要なことに、学習効率が極めて高い——25%のパッチのみをエンコードすることで、メモリと計算要件が劇的に削減される。

DINO:自己蒸留から創発する意味

Caronら[3]はDINO(self-distillation with no labels)を提案し、異なるアプローチを取った——自己蒸留。最も衝撃的な発見は、自己教師ありViTのアテンションマップがピクセルレベルのアノテーションなしでセマンティックセグメンテーションを自動的に学習することであった:

DINOアーキテクチャ:

生徒ネットワーク g_θs ←── 勾配更新

教師ネットワーク g_θt ←── 指数移動平均(EMA):θt ← λθt + (1-λ)θs

学習フロー:

1. 同じ画像 → 2セットの異なるデータ拡張(クロップ)

- グローバルクロップ(224×224):2つ

- ローカルクロップ(96×96):複数

2. 教師がグローバルクロップを処理 → softmax(g_θt(x) / τ_t)(τ_t小 → シャープな分布)

3. 生徒が全クロップを処理 → softmax(g_θs(x) / τ_s)

4. 損失:交差エントロピー H(p_teacher, p_student)

キー:ローカルクロップの生徒がグローバルクロップの教師出力を予測しなければならない

→ ローカルビューからグローバルな意味を理解することをモデルに強制

DINOのアテンションマップ → 物体の境界とセマンティックセグメンテーションが自動的に創発

(ピクセルレベルのアノテーションなし、純粋に自己教師あり学習から創発)

DINOv2[15]はさらに自己蒸留とマスク予測の目的関数を統合し、大規模キュレーションデータセットで学習することで強力な汎用視覚特徴を生成——分類、セグメンテーション、深度推定などのタスクにおいてファインチューニングなしで優れた性能を達成した。

5. 実践ラボ1:BERTマスク言語モデル予測とファインチューニング(Google Colab)

以下の実験ではHuggingFace Transformersを使って2つの操作を行う:(1) BERT MLMの穴埋め予測で事前学習モデルの言語理解能力を観察、(2) SST-2感情分類タスクでBERTをファインチューニングし「事前学習→ファインチューニング」パラダイムを体験。

# ============================================================

# ラボ1:BERT——MLMマスク予測 + SST-2感情分類ファインチューニング

# 環境:Google Colab(CPUで十分、GPUでファインチューニングを高速化)

# ============================================================

# --- 0. インストール ---

!pip install -q transformers datasets torch

import torch

from transformers import (

BertTokenizer, BertForMaskedLM,

BertForSequenceClassification, Trainer, TrainingArguments

)

from datasets import load_dataset

import numpy as np

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

print(f"Device: {device}")

# ============================================================

# パートA:MLM穴埋め予測

# ============================================================

print("\n" + "="*60)

print("Part A: BERT Masked Language Model Prediction")

print("="*60)

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

mlm_model = BertForMaskedLM.from_pretrained('bert-base-uncased').to(device)

mlm_model.eval()

# テスト文

test_sentences = [

"The capital of France is [MASK].",

"Artificial [MASK] is transforming every industry.",

"The cat sat on the [MASK].",

"Self-supervised learning uses [MASK] data for pre-training.",

"BERT was developed by [MASK] AI research team.",

]

print("\n--- MLM Predictions ---")

for sentence in test_sentences:

inputs = tokenizer(sentence, return_tensors='pt').to(device)

mask_idx = (inputs['input_ids'] == tokenizer.mask_token_id).nonzero(as_tuple=True)[1]

with torch.no_grad():

outputs = mlm_model(**inputs)

logits = outputs.logits

mask_logits = logits[0, mask_idx[0]]

top5 = torch.topk(mask_logits, 5)

print(f"\nInput: {sentence}")

print("Top-5 predictions:")

for i, (score, idx) in enumerate(zip(top5.values, top5.indices)):

token = tokenizer.decode([idx.item()])

print(f" {i+1}. {token:15s} (score: {score.item():.2f})")

# ============================================================

# パートB:SST-2感情分類ファインチューニング

# ============================================================

print("\n" + "="*60)

print("Part B: BERT Fine-tuning on SST-2 Sentiment Classification")

print("="*60)

# --- 1. データ読み込み ---

dataset = load_dataset("glue", "sst2")

print(f"Train: {len(dataset['train'])}, Val: {len(dataset['validation'])}")

print(f"Sample: {dataset['train'][0]}")

# --- 2. トークン化 ---

def tokenize_fn(examples):

return tokenizer(examples['sentence'], truncation=True, padding='max_length', max_length=128)

tokenized = dataset.map(tokenize_fn, batched=True)

tokenized = tokenized.rename_column("label", "labels")

tokenized.set_format("torch", columns=["input_ids", "attention_mask", "labels"])

# デモの高速化のためサブセットを使用(Colab対応)

small_train = tokenized["train"].shuffle(seed=42).select(range(2000))

small_val = tokenized["validation"]

# --- 3. モデル読み込み ---

model = BertForSequenceClassification.from_pretrained(

'bert-base-uncased', num_labels=2

).to(device)

# --- 4. 学習 ---

def compute_metrics(eval_pred):

logits, labels = eval_pred

preds = np.argmax(logits, axis=-1)

acc = (preds == labels).mean()

return {"accuracy": acc}

training_args = TrainingArguments(

output_dir="./bert-sst2",

num_train_epochs=3,

per_device_train_batch_size=32,

per_device_eval_batch_size=64,

eval_strategy="epoch",

save_strategy="no",

learning_rate=2e-5,

weight_decay=0.01,

logging_steps=50,

report_to="none",

fp16=torch.cuda.is_available(),

)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=small_train,

eval_dataset=small_val,

compute_metrics=compute_metrics,

)

print("\nFine-tuning BERT on SST-2 (2000 samples, 3 epochs)...")

trainer.train()

# --- 5. 評価 ---

results = trainer.evaluate()

print(f"\n--- Results ---")

print(f"Validation Accuracy: {results['eval_accuracy']:.4f}")

# --- 6. 推論デモ ---

print("\n--- Inference Demo ---")

test_texts = [

"This movie is absolutely wonderful and inspiring!",

"The film was boring, poorly acted, and a waste of time.",

"An interesting concept but the execution was mediocre.",

"I loved every minute of this brilliant masterpiece.",

]

model.eval()

for text in test_texts:

inputs = tokenizer(text, return_tensors='pt', truncation=True, max_length=128).to(device)

with torch.no_grad():

logits = model(**inputs).logits

pred = torch.argmax(logits, dim=-1).item()

prob = torch.softmax(logits, dim=-1)[0]

label = "Positive" if pred == 1 else "Negative"

print(f" [{label} {prob[pred]:.2%}] {text}")

print("\nLab 1 Complete!")

6. 実践ラボ2:MAE画像マスク復元の可視化(Google Colab)

以下の実験ではHuggingFaceの事前学習済みViT-MAEモデルを使用して実画像のマスク復元を行い、オリジナル・マスク済み・復元済みの3列比較を可視化する。

# ============================================================

# ラボ2:MAE——画像マスク復元の可視化

# 環境:Google Colab(CPUで十分)

# ============================================================

# --- 0. インストール ---

!pip install -q transformers torch pillow requests matplotlib

import torch

import numpy as np

import matplotlib.pyplot as plt

from PIL import Image

import requests

from transformers import ViTMAEForPreTraining, ViTMAEConfig, ViTFeatureExtractor

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

print(f"Device: {device}")

# --- 1. 事前学習済みMAEモデルの読み込み ---

print("Loading ViT-MAE model...")

feature_extractor = ViTFeatureExtractor.from_pretrained('facebook/vit-mae-base')

model = ViTMAEForPreTraining.from_pretrained('facebook/vit-mae-base').to(device)

model.eval()

print(f"Model params: {sum(p.numel() for p in model.parameters()):,}")

# --- 2. テスト画像の読み込み ---

urls = [

"https://upload.wikimedia.org/wikipedia/commons/thumb/4/47/PNG_transparency_demonstration_1.png/280px-PNG_transparency_demonstration_1.png",

"https://upload.wikimedia.org/wikipedia/commons/thumb/a/a7/Camponotus_flavomarginatus_ant.jpg/320px-Camponotus_flavomarginatus_ant.jpg",

]

images = []

for url in urls:

try:

img = Image.open(requests.get(url, stream=True, timeout=10).raw).convert('RGB')

images.append(img)

print(f"Loaded image: {img.size}")

except Exception as e:

print(f"Failed to load {url}: {e}")

# 読み込み失敗時は合成画像を使用

if len(images) == 0:

print("Using synthetic test images...")

img = Image.fromarray(np.random.randint(0, 255, (224, 224, 3), dtype=np.uint8))

images = [img]

# --- 3. MAE復元関数 ---

def mae_reconstruct(model, feature_extractor, image, mask_ratio=0.75):

"""MAEマスク復元を実行"""

# 前処理

inputs = feature_extractor(images=image, return_tensors='pt')

pixel_values = inputs['pixel_values'].to(device)

# 順伝搬(モデル内部でランダムマスキングが適用される)

with torch.no_grad():

outputs = model(pixel_values)

# マスキング情報の取得

mask = outputs.mask # [1, num_patches], 1=マスク済み, 0=可視

pred = outputs.logits # [1, num_patches, patch_size**2 * 3]

return pixel_values, pred, mask

def visualize_reconstruction(pixel_values, pred, mask, image_size=224, patch_size=16):

"""オリジナル、マスク済み、復元済みの画像を可視化"""

# パッチ数の計算

num_patches_per_side = image_size // patch_size

num_patches = num_patches_per_side ** 2

# 元画像(テンソルから復元)

original = pixel_values[0].cpu()

# 非正規化

mean = torch.tensor(feature_extractor.image_mean).view(3, 1, 1)

std = torch.tensor(feature_extractor.image_std).view(3, 1, 1)

original = original * std + mean

original = original.clamp(0, 1).permute(1, 2, 0).numpy()

# 復元画像(パッチ予測から組み立て)

pred_patches = pred[0].cpu() # [num_patches, patch_size**2 * 3]

pred_img = pred_patches.reshape(num_patches_per_side, num_patches_per_side,

patch_size, patch_size, 3)

pred_img = pred_img.permute(0, 2, 1, 3, 4).reshape(image_size, image_size, 3)

pred_img = pred_img.numpy()

pred_img = pred_img * feature_extractor.image_std + feature_extractor.image_mean

pred_img = np.clip(pred_img, 0, 1)

# マスク画像(マスク領域をグレーで埋める)

mask_np = mask[0].cpu().numpy()

masked_img = original.copy()

for i in range(num_patches):

if mask_np[i] == 1:

row = i // num_patches_per_side

col = i % num_patches_per_side

r_start, r_end = row * patch_size, (row + 1) * patch_size

c_start, c_end = col * patch_size, (col + 1) * patch_size

masked_img[r_start:r_end, c_start:c_end] = 0.5

# 統合画像:マスク位置は復元を使用、可視位置はオリジナルを使用

combined = original.copy()

for i in range(num_patches):

if mask_np[i] == 1:

row = i // num_patches_per_side

col = i % num_patches_per_side

r_start, r_end = row * patch_size, (row + 1) * patch_size

c_start, c_end = col * patch_size, (col + 1) * patch_size

combined[r_start:r_end, c_start:c_end] = pred_img[r_start:r_end, c_start:c_end]

mask_ratio = mask_np.sum() / len(mask_np)

return original, masked_img, combined, mask_ratio

# --- 4. 復元の実行と可視化 ---

n_images = len(images)

fig, axes = plt.subplots(n_images, 3, figsize=(15, 5 * n_images))

if n_images == 1:

axes = axes[np.newaxis, :]

for idx, img in enumerate(images):

pixel_values, pred, mask = mae_reconstruct(model, feature_extractor, img)

original, masked_img, combined, mask_ratio = visualize_reconstruction(pixel_values, pred, mask)

axes[idx, 0].imshow(original)

axes[idx, 0].set_title(f'Original Image', fontsize=13)

axes[idx, 0].axis('off')

axes[idx, 1].imshow(masked_img)

axes[idx, 1].set_title(f'Masked ({mask_ratio:.0%} patches hidden)', fontsize=13)

axes[idx, 1].axis('off')

axes[idx, 2].imshow(combined)

axes[idx, 2].set_title('Reconstruction (masked patches filled)', fontsize=13)

axes[idx, 2].axis('off')

plt.suptitle('MAE: Masked Autoencoder — Image Reconstruction', fontsize=16, y=1.02)

plt.tight_layout()

plt.show()

# --- 5. マスク率実験 ---

print("\n--- Mask Ratio Experiment ---")

print("MAE uses a 75% masking ratio. Let's observe reconstruction quality under standard masking:")

pixel_values, pred, mask = mae_reconstruct(model, feature_extractor, images[0])

mask_np = mask[0].cpu().numpy()

visible_count = (mask_np == 0).sum()

masked_count = (mask_np == 1).sum()

total = len(mask_np)

print(f"Total patches: {total}")

print(f"Visible patches: {visible_count} ({visible_count/total:.1%})")

print(f"Masked patches: {masked_count} ({masked_count/total:.1%})")

print(f"\nMAEの設計洞察:画像は高い空間冗長性を持つため、")

print(f"有意義な表現を学習させるには75%のパッチをマスクする必要がある。")

print(f"比較として、BERTはトークンの15%しかマスクしない——")

print(f"言語は画像よりもはるかに高い情報密度を持つからである。")

print("\nLab 2 Complete!")

7. 意思決定フレームワーク:企業はSSL戦略をどう選ぶべきか

多様なSSL手法に直面して、企業はデータの種類、計算リソース、応用シナリオに基づいて選択を行う必要がある:

| 手法 | モダリティ | 事前学習目的 | 計算要件 | 用途 | 下流タスク転移 |

|---|---|---|---|---|---|

| BERT[1] | テキスト | MLM + NSP | 中(4-16 TPU日) | テキスト分類、NER、QA | ファインチューニング + [CLS]分類 |

| GPT[5] | テキスト | 自己回帰CLM | 高(数千GPU日) | テキスト生成、対話、推論 | プロンプト / In-context |

| MAE[2] | 画像 | マスクパッチ復元 | 中(ViT-L 1600エポック) | 画像分類、物体検出 | 全モデルファインチューニング |

| DINO[3] | 画像 | 自己蒸留 + マルチクロップ | 中〜高 | セグメンテーション、検索、ゼロショット | 線形プロービング / k-NN |

| SimCLR[4] | 画像 | 対照学習 | 高(大バッチ必要) | 汎用視覚表現 | 線形プロービング / ファインチューニング |

| wav2vec 2.0[11] | 音声 | マスキング + 対照 | 中 | 音声認識、話者識別 | CTCファインチューニング |

SSL戦略選択の判断ロジック:

判断ツリー:

1. データのモダリティは?

├── テキスト → 2a

├── 画像 → 2b

└── 音声 → wav2vec 2.0

2a. テキストのタスク種別は?

├── 理解(分類/NER/QA) → BERTファミリー(双方向エンコーダー)

└── 生成(要約/対話/翻訳) → GPTファミリー(自己回帰デコーダー)

2b. ラベル付きデータの量は?

├── 豊富(>10Kラベル付きサンプル) → MAE(ファインチューニング後に最適)

├── 少量(<1Kラベル付きサンプル) → DINO(ゼロショット/線形プロービングに強い)

└── ほぼなし → DINOv2(凍結特徴 + k-NN分類器)

3. 計算予算は?

├── 限定的 → オープンソース事前学習モデルを使用(HuggingFace Hub)

└── 十分 → ドメインデータで継続事前学習(ドメイン適応)

8. 事前学習から競争優位へ:SSLの戦略的価値

自己教師あり学習は単なる技術ではなく、企業のAI戦略を再構築している。基盤モデル[13]のコンセプトが示すトレンドは明確である:大規模自己教師あり事前学習モデルがAIインフラストラクチャとなり、電力やインターネットと同様に不可欠なものとなりつつある。

ドメイン特化事前学習

企業にとって最も戦略的価値の高いSSL応用はドメイン特化事前学習である:汎用モデルの上に独自のラベルなしデータで継続的に事前学習し、競合が容易に複製できない技術的堀を構築する:

ドメイン事前学習の例:

バイオメディカル: PubMedBERT——PubMed論文で事前学習 → バイオメディカルNLP SOTA

金融: FinBERT——金融ニュースとレポートで事前学習 → 感情分析SOTA

法律: Legal-BERT——法律文書で事前学習 → 契約分析

コード: CodeBERT——コード-ドキュメントペアで事前学習 → コード検索/生成

一般パターン:

オープンソースベースモデル → ドメインコーパスで継続事前学習 → 少量ラベルデータでファインチューニング → デプロイ

ROI:

✓ 企業内の大量のラベルなしデータを活用(文書、ログ、画像)

✓ アノテーション要件を劇的に削減(数万から数百へ)

✓ 複製困難なドメインモデルを構築(データを堀として)

✓ 複数タスクの統一表現基盤(1回の事前学習、多数のファインチューニング)

企業AI戦略へのSSLの示唆

AI投資を評価する意思決定者にとって、SSLは3つの重要な示唆をもたらす:

- データ戦略の転換:少量の精密ラベルデータではなく、大量のラベルなしデータの収集に投資する方がAI ROI評価が高い。企業は高コストなアノテーションワークフローではなく、体系的なデータ収集パイプラインを構築すべきである。

- 計算投資のレバレッジ効果:1回の事前学習投資が複数の下流タスクに活用できる。事前学習コストは高いが、数十のアプリケーションシナリオに分散すると、単位コストはタスクごとにゼロから学習するよりはるかに低くなる。

- オープンソースエコシステムの戦略的活用:HuggingFace Hubには50万以上の事前学習モデルがホストされている。企業はゼロから事前学習する必要はなく、最も近いオープンソースモデルを選択してドメインデータで継続事前学習することで、迅速な差別化が可能になる。

9. 結論と展望

自己教師あり学習は過去10年間でAIにおける最も重要なパラダイムシフトの一つである。BERT[1]のマスク言語モデルからMAE[2]のマスク画像復元、SimCLR[4]の対照学習からDINO[3]の自己蒸留まで、SSLは複数の形態を通じてコアな命題を証明した:データの構造自体が豊富な監督信号を含んでいる。

コアナラティブを振り返る:

- アノテーションボトルネックの突破:SSLがインターネット上の事実上無限のラベルなしデータを解放し、BERTとGPTシリーズの成功がデータスケールの決定的役割を証明した

- 統一的な事前学習フレームワーク:「マスク-予測」パラダイム(MLM、MAE、BEiT[14])がテキストと画像ドメインにわたる顕著な汎用性を示した

- 表現品質の飛躍:自己教師あり表現がほとんどの下流タスクで教師あり学習に匹敵するか上回り、DINOのアテンションマップは教師なしセマンティック理解の創発をさらに実証した

- 基盤モデルパラダイム:大規模自己教師あり事前学習[13] + 軽量ファインチューニングが標準的なAI開発ワークフローとなった

今後のSSLの発展方向には以下が含まれる:マルチモーダル統一事前学習(ImageBindのような6モダリティの統一)、より効率的な事前学習手法(有効性を維持しながら計算要件を削減)、静的な事前学習から継続学習への移行(デプロイ後もモデルが新しいデータから学び続ける)。Transformerアーキテクチャ[7]がモダリティを横断する統一的な計算基盤を提供し、SSLがモダリティを横断する統一的な学習パラダイムを提供する——この両者の組み合わせが、真に汎用的な人工知能インフラストラクチャの触媒となっている。