OpenClawをまだインストールしていませんか?ワンラインインストールコマンドはこちら

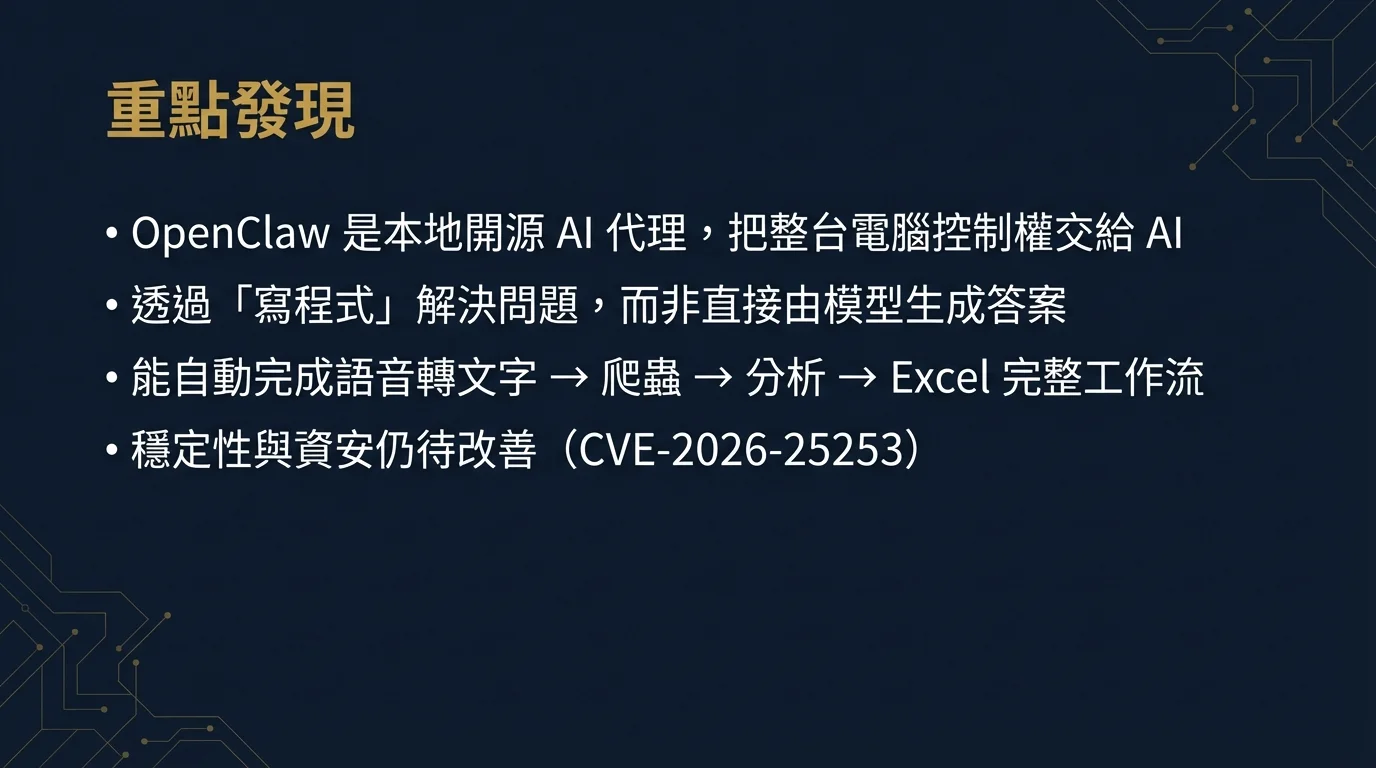

curl -fsSL https://openclaw.ai/install.sh | bashiwr -useb https://openclaw.ai/install.ps1 | iexcurl -fsSL https://openclaw.ai/install.cmd -o install.cmd && install.cmd && del install.cmd- OpenClawチュートリアル(旧ClawdBot / MoltBot)は、ローカルコンピュータにインストールするオープンソースのAIエージェントである。ChatGPTやManusとの最大の違いは、コンピュータ全体の制御をAIに委ねる点にある

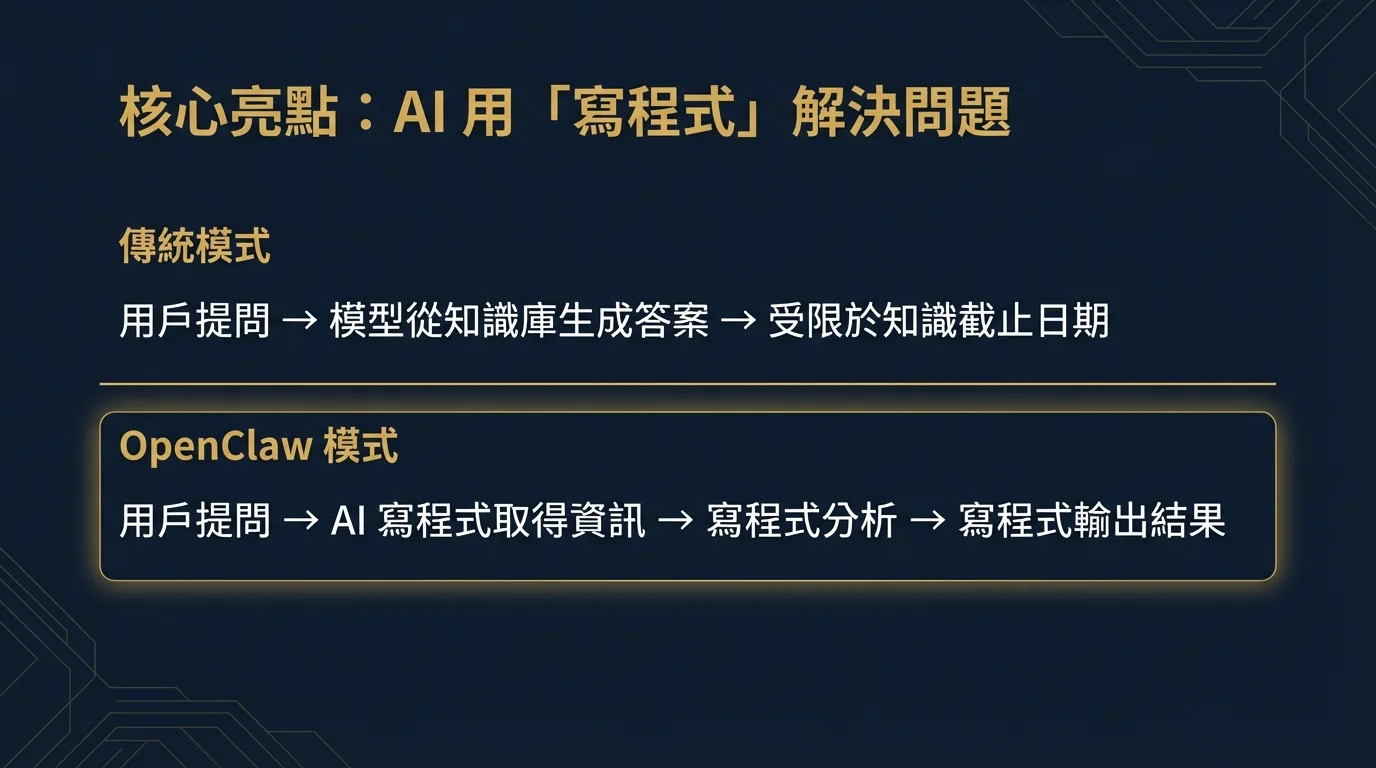

- 初めてのユーザーは「大規模言語モデルに接続しただけの単なるチャットツール」と誤解しがちだが、最大の特長はLLMを活用して「コードを書く」ことでユーザーの課題を解決する点にある——モデルが直接回答を生成するのではない

- 当チームの実機テストでは、OpenClawが音声からテキストへの変換、Pythonによるウェブスクレイピング、データ分析、Excel出力に至るワークフロー全体を、人間の介入なしに自律的に完了できることが確認された

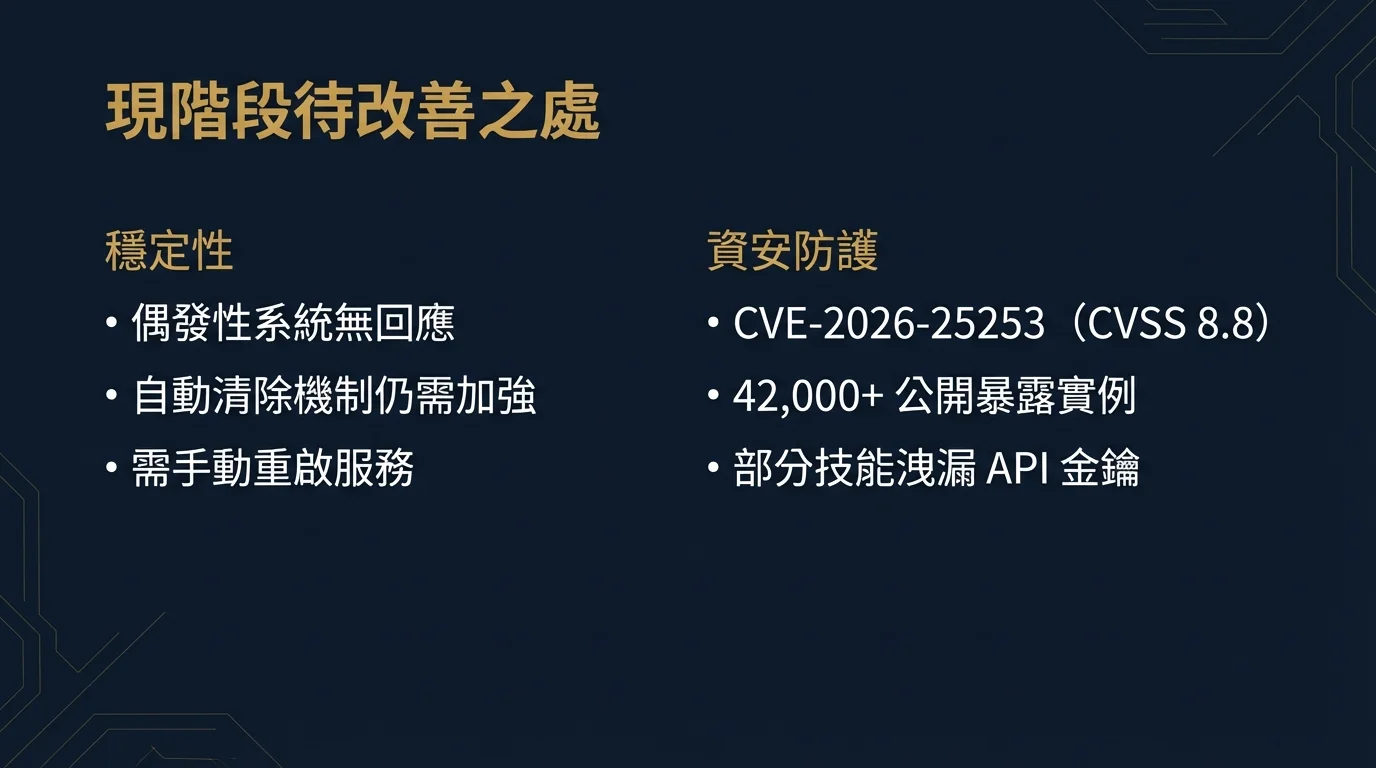

- 原因不明のフリーズや安定性の問題が依然として存在し、GitHub史上最速で10万スターに到達した記録的な成長の裏には、深刻なセキュリティ上の懸念(CVE-2026-25253)が潜んでいる

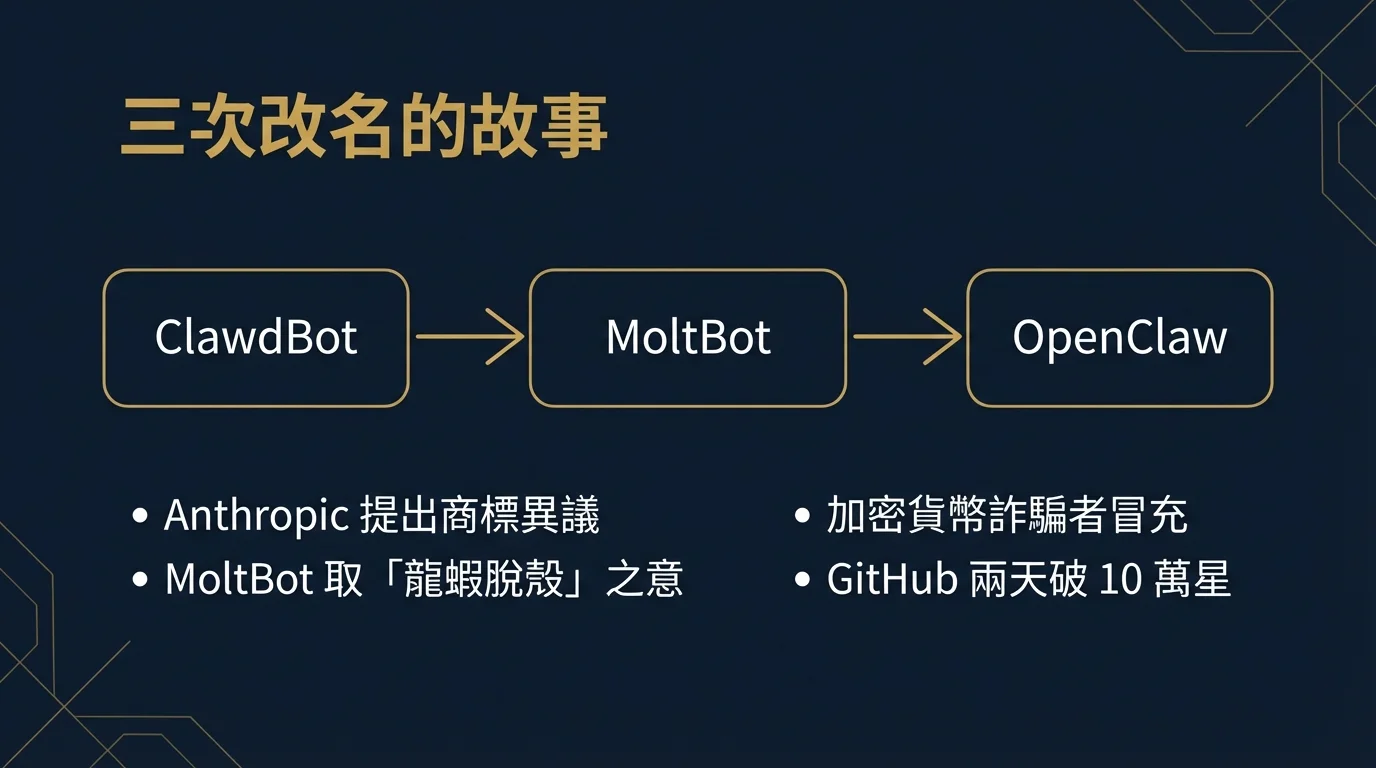

1. OpenClawとは:3度の改名に秘められた物語

OpenClawは、オーストリアのソフトウェア開発者Peter Steinberger(PSPDFKit創業者)が開発したオープンソースの自律型AIエージェントである[1]。その命名の歴史自体がひとつの物語となっている。元々はClawdBot(AnthropicのClaudeをもじった名前)と呼ばれていたが、2026年1月にAnthropicから商標に関する異議が提起され、MoltBot(ロブスターの脱皮を意味するmoltingに由来)に改名。さらに3日後、MoltBotの語感が弱く、暗号通貨詐欺師がなりすましに走ったことから、再びOpenClawに改名された[2]。

GitHubにおけるプロジェクトの成長速度はあらゆる記録を塗り替えた。わずか2日間で10万スターを突破し、ピーク時には毎時710の新規スターを獲得した[3]。比較として、Reactが同様のスター数に達するまで約8年、Linuxは約12年を要している。2026年2月初旬時点で、OpenClawは14万5,000以上のスターと2万以上のフォークを集めている。

2. ChatGPTおよびManus AIとの本質的な違い

この数日間、当チームはOpenClawを集中的にテストしてきた。最初に受けた印象は極めて直感的なものだった。ChatGPTやManus AIとはまったく異なるカテゴリーのツールである。

ChatGPTは本質的にクラウドベースの対話型AIであり、ユーザーが質問すると情報を検索して回答する。Manus AIはクラウドベースのAIエージェントで、リモートサンドボックス環境でウェブアプリケーションを操作できる。OpenClawのポジショニングは根本的に異なる。ユーザー自身のコンピュータ(またはクラウドサーバー)にインストールされ、コンピュータ全体の制御をAIに委ねるのである[4]。

具体的には、OpenClawのアーキテクチャは4つのコアレイヤーで構成される[5]。

- ゲートウェイ:WhatsApp、Telegram、Slack、Discord、Signalなど10以上のメッセージングプラットフォームに接続

- エージェント(エンジン):外部LLM(Claude、GPT、DeepSeek、またはOllamaのローカルモデル)を推論コアとして統合

- スキル(モジュール):ブラウザ自動化、ファイルシステム操作、カレンダー連携、シェルコマンド実行など100以上の拡張可能な機能

- メモリ(永続化レイヤー):Markdownファイルを使用して会話コンテキストとユーザー設定を永続的に保存

つまり、LINEやWhatsAppでメッセージを送るだけで、OpenClawがコンピュータ上で対応する操作を実行する——メール送信、ファイル整理、プログラム実行、さらにはスマートホームデバイスの制御まで。この「AIがコンピュータを管理する」パラダイムは、現在の主要AIツールのいずれも実現していないものである。

3. 最初の誤解:単なるチャットラッパーだと思っていた

正直に言うと、当チームがOpenClawを初めて使い始めた時、最初の反応は失望だった。インターフェースは大規模言語モデルに接続しただけの単なるチャットツールにMCP(Model Context Protocol)機能を追加したように見え、Claude APIやChatGPTを直接使うのと変わらないように思えた。洗練されたウェブインターフェースを持つManus AIと比べると、むしろ見劣りするほどだった。

Platformerのレビューでも同様の指摘がなされており[6]、多くの初期ユーザーが「最初の驚き、その後の失望、そして再認識」というサイクルを経験している。AI研究者のGary Marcusに至っては、OpenClawは大規模言語モデルのラッパーに過ぎず、経験豊富な開発者であれば同様のものを構築できるとまで述べている[7]。

しかし、より深く使い込むうちに、その真価を理解し始めた。

4. 真の核心:AIがコードを書いて問題を解決する

OpenClawで最も感銘を受けたのは、そのインターフェースや機能リストではなく、問題を解決する方法そのものだった。

一般的なAIツール(ChatGPT、Gemini、Claude)はLLMの企業ナレッジマネジメント能力から直接回答を生成してユーザーの問題を解決する。OpenClawのアプローチはまったく異なる——LLMを活用してコードを書くことでユーザーの問題を解決するのである。

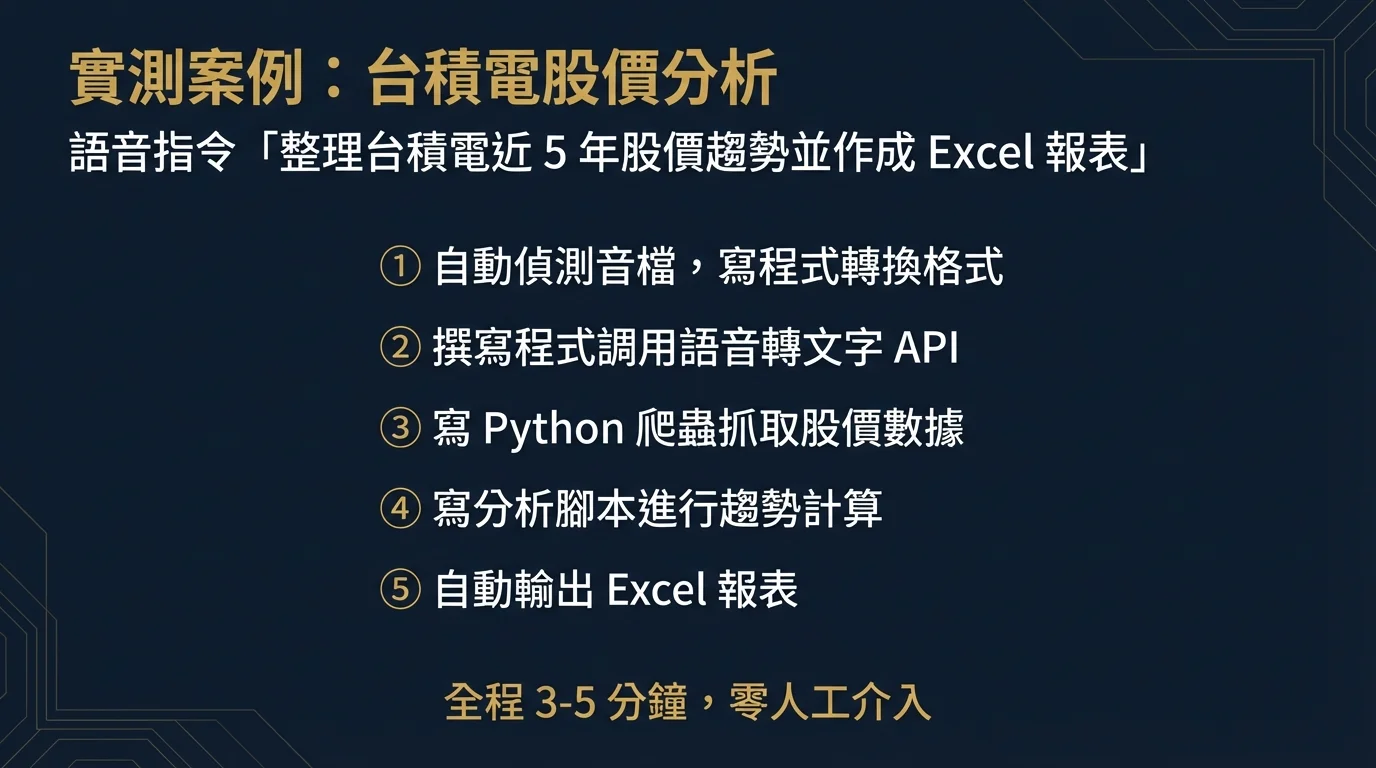

当チームのテストにおける実例を紹介しよう。「過去5年間のTSMCの株価推移をまとめ、Excelレポートを作成してください」という音声プロンプトを使用した。その後に起きたことに、チームメンバー全員が画面に釘付けになった。

- OpenClawが入力が音声ファイルであることを検知し、APIが受け入れ可能な形式に音声を変換するプログラムを自ら作成

- 次に、音声をテキスト指示に変換するため音声認識APIを呼び出す別のプログラムを自ら作成

- 続いて、PythonでTSMCの過去の株価データを取得するウェブスクレイパーを自ら作成

- 株価データをダウンロード後、データを整理しトレンドを計算する分析スクリプトを自ら作成

- 最後に、分析結果をExcel形式で出力するプログラムを自ら作成し、レポートを完成させた

プロセス全体は約3〜5分で完了し、人間の介入は一切不要だった。各ステップでOpenClawはリアルタイムにコードを生成し、実行し、結果を確認してから次のステップに進んだ。

5. ポテンシャル:モデル自体に制限されない、コードによる問題解決

この「AIがコードを書いて問題を解決する」パラダイムは、我々の見解では、OpenClawの最も革新的な設計思想である。そこには重要なパラダイムシフトが示されている。

従来のパラダイム:ユーザーが質問 -> LLMが学習知識から直接回答を生成 -> モデルの学習データ、知識のカットオフ日、コンテキストウィンドウに制限される

OpenClawのパラダイム:ユーザーが質問 -> LLMが必要な情報とツールを判断 -> コードを書いて情報を取得 -> コードを書いて処理・分析 -> コードを書いて結果を出力

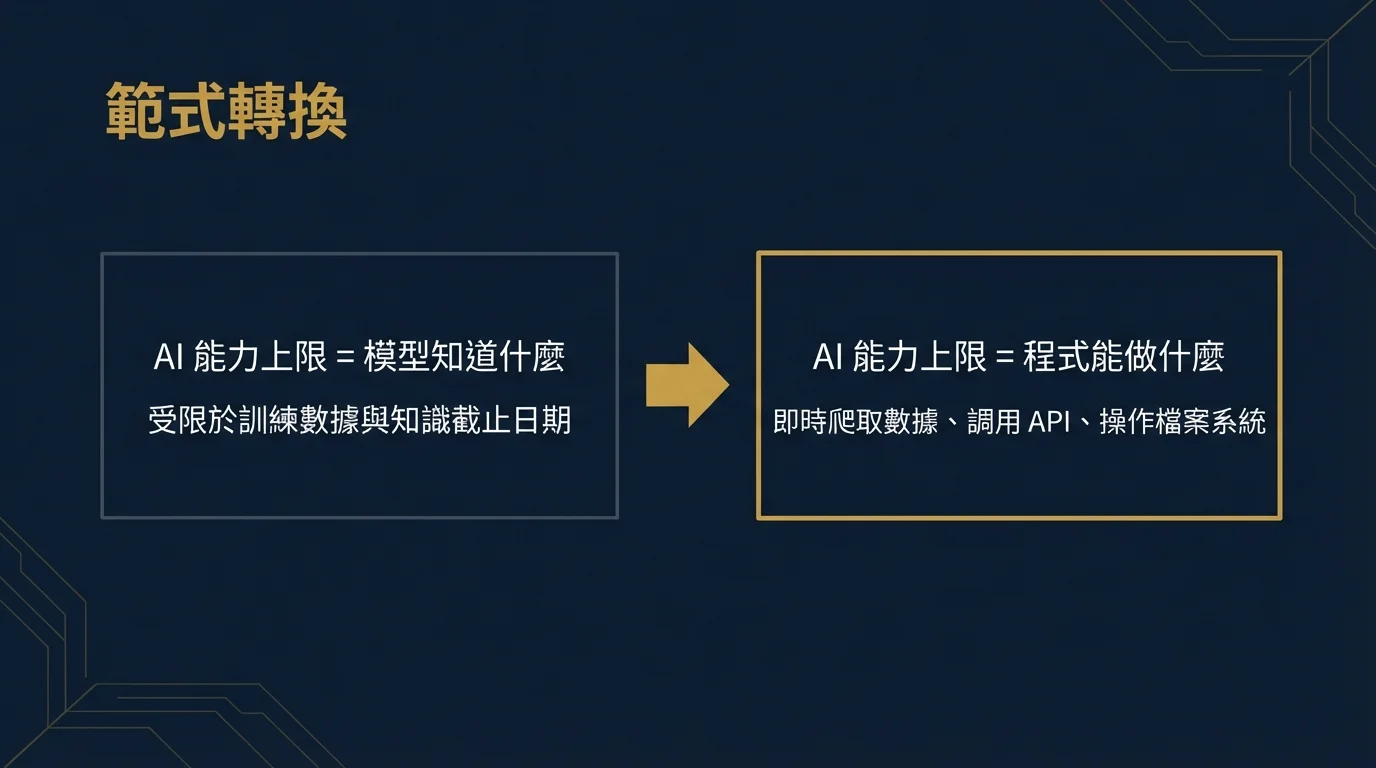

これは、AIがもはやLLMが「知っている」ことに制限されず、「どのようなコードを書けるか」に制限されることを意味する——そして現代のLLMのコード記述能力は既に非常に強力である。最新データのリアルタイムスクレイピング、任意のAPIの呼び出し、ローカルファイルシステムの操作、複雑なデータ分析パイプラインの実行が可能だ。Pragmatic Engineerの詳細レポートでも[8]、Steinberger自身が開発プロセスを「読まないコードを出荷している」と表現している——OpenClawが生成するコード量は、人間が一行ずつレビューできる範囲をすでに超えている。

企業にとって、このパラダイムのポテンシャルは計り知れない。あるシナリオを想像してほしい。マーケティング部門のディレクターが音声で「先月の全プラットフォームにおけるソーシャルメディアエンゲージメントデータを分析し、競合と比較して、プレゼンテーションを作成して」と指示する。OpenClawはデータ収集用のスクレイパーを自ら作成し、比較用の分析スクリプトを書き、チャートを生成するコードを書き、さらにチャートをPowerPointにまとめるコードまで書いて——すべて自動的に完了する。

6. 現状の課題:安定性とセキュリティ

6.1 原因不明のフリーズ

実機テストで直面した最大の問題は安定性である。OpenClawは一定の確率で原因不明のフリーズが発生する——システムが完全に応答しなくなり、新しいコマンドを受け付けなくなる。OpenClawには、長時間停滞したタスクを検出して削除する自動クリーンアップ機構が内蔵されているが、特定の状況ではこの機構自体が機能せず、最終的にエージェント全体が完全にクラッシュする。

この場合、唯一の解決策はホストマシンでOpenClawサービスを手動で再起動することである。クラウドにデプロイしているユーザーの場合、サーバーにSSH接続して操作する必要がある——一般的なユーザーにとって許容できる体験ではない。

6.2 深刻なセキュリティ上の懸念

さらに懸念されるのはセキュリティの問題である。2026年2月初旬、セキュリティ研究者がCVE-2026-25253脆弱性(CVSS 8.8 高)を発見した[9]。攻撃者は特別に細工されたリンクをユーザーにクリックさせるだけで、クロスサイトWebSocketハイジャックを通じてOpenClawのフルコントロールを奪取し、ユーザーのコンピュータ上で任意のコマンドを実行できる。

CrowdStrikeの調査ではさらに[10]、インターネット上に4万2,000以上の公開されたOpenClawインスタンスが存在し、そのうち93.4%が認証バイパスの脆弱性を抱えていることが明らかになった。The Registerの報道では[11]、OpenClawスキルマーケットプレイスのスキルの約7.1%がAPIキーを平文で漏洩していると指摘されている。Ciscoのセキュリティチームはさらに踏み込み[12]、OpenClawのようなパーソナルAIエージェントは本質的にサイバーセキュリティの悪夢であると述べている——シェルアクセス、ネットワーク接続、プロンプトインジェクション攻撃面を兼ね備えており、ハッカーにとって理想的な標的となるからである。

OpenClawがコンピュータの完全な制御権を持つことを考えると、これらのセキュリティ脆弱性の深刻度は一般的なアプリケーションをはるかに超える。Gary Marcusは鮮やかな比喩を用いている[7]:OpenClawを使うことは、バーで見知らぬ人にすべてのパスワードを渡すようなものだ。

7. 我々の見解:注目に値するが、本番環境には未対応

数日間の集中テストを経て、OpenClawに対する当チームの総合評価は次の通りである。ビジョンは先見的、実装は粗削り、ポテンシャルは巨大。

OpenClawが示す「AIがコードを書いて問題を解決する」パラダイムは、AIエージェント開発の重要な方向性となりうる。AIがモデル自体の知識の境界に制限されず、リアルタイムにコードを書いてあらゆる情報の取得・処理・分析が可能になれば、その能力の上限は「モデルが知っていること」から「コードで何ができるか」へと移行する——そして後者は事実上無限である。

しかし現段階では、不十分な安定性と懸念されるセキュリティにより、いかなる本番環境にも適していない。技術的好奇心の強い開発者にとっては、隔離されたテスト環境でOpenClawを体験する価値はある。しかし企業ユーザーには、セキュリティアーキテクチャと安定性に実質的な改善が見られるまで、様子を見ることを推奨する。

AIエージェントの時代は確かに到来しつつある。OpenClawのバイラルな成功は偶然ではない——AI自動化に対する根深いニーズに応えているのだ。しかし、あらゆる技術の波と同様に、第一波の製品は最も粗削りになる傾向がある。真の問いは、OpenClawが今すぐ使えるかどうかではなく、OpenClawが示す「AIがコードを書いて問題を解決する」パラダイムが、今後1〜2年でより成熟した製品によってどのように実現されるかである。

当チームはOpenClawおよび類似のAIエージェントの動向を引き続き追跡していく。AI自動化ツールの採用戦略を評価中の企業は、ぜひ当研究チームとの技術的な深い議論を歓迎したい——ツールが溢れる時代において、正しい方向を選ぶことは、トレンドを追いかけることよりも重要である。