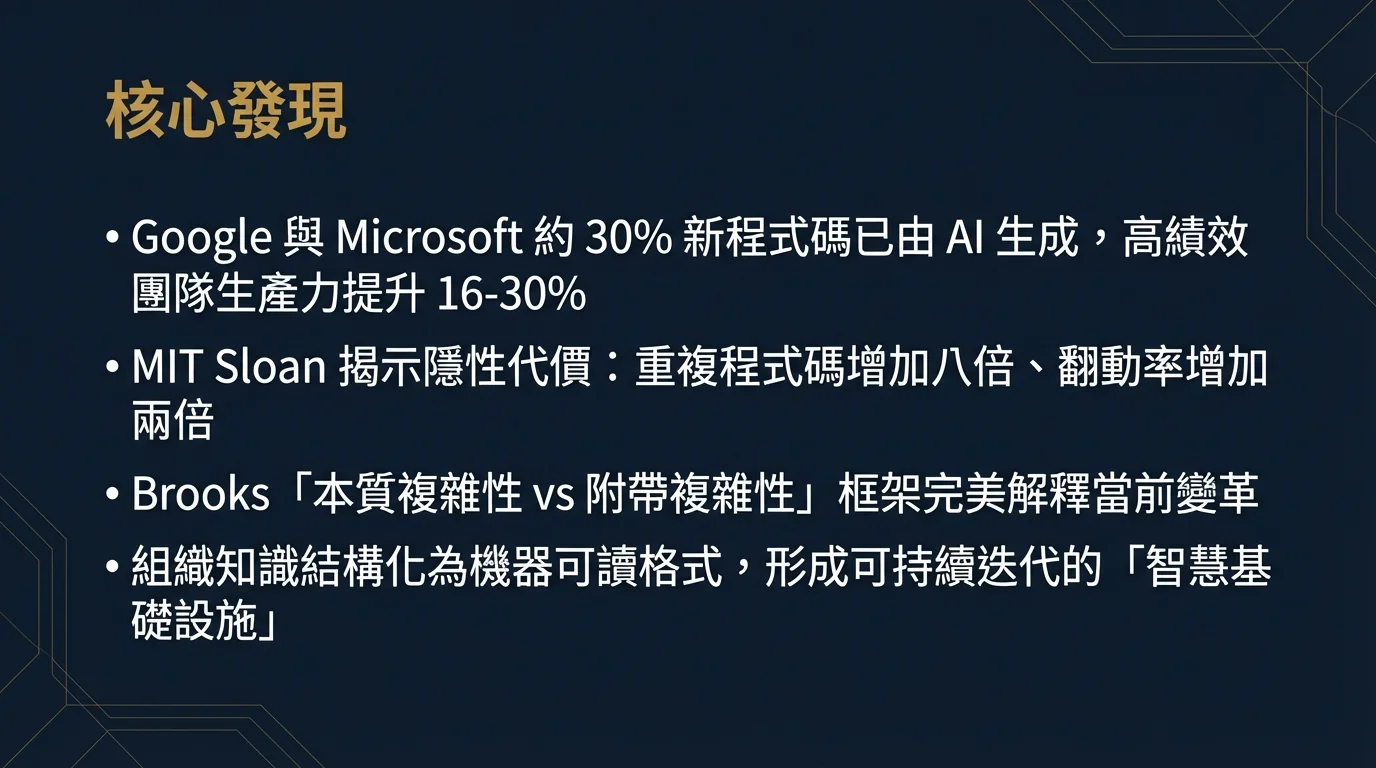

- Ein BCG-Bericht zeigt, dass bei Google und Microsoft rund 30 % des neuen Codes bereits von KI generiert werden. McKinsey hat über 600 Organisationen untersucht und festgestellt, dass leistungsstarke Teams eine Produktivitätssteigerung von 16–30 % und eine Qualitätsverbesserung von 31–45 % erzielen — allerdings nur in Unternehmen, die gleichzeitig Prozesse und Organisation transformieren

- Das MIT Sloan Management Review deckt die versteckten Kosten KI-gestützter Entwicklung auf: Duplizierte Codeblöcke haben sich verachtfacht, die Code-Churn-Rate (Anteil kurz nach dem Schreiben geänderter oder gelöschter Codes) hat sich verdoppelt — schnelle Ergebnisse beschleunigen paradoxerweise die Anhäufung von Technical Debt

- Brooks' 1987 formuliertes Rahmenwerk „Essenzielle vs. akzidentelle Komplexität" liefert die präziseste Analyselinse für den aktuellen Wandel im Software Engineering: Generative KI eliminiert massiv akzidentelle Komplexität, doch essenzielle Komplexität — Anforderungsverständnis, Architektururteil, Domänenmodellierung — erfordert weiterhin tiefe menschliche Expertise

- Unsere Praxis zeigt: Die systematische Strukturierung von Teamwissen in maschinenlesbare Formate (Markdown-Dateien, KI-Skill-Definitionen) ermöglicht es KI-Tools, bei jeder Ausführung automatisch Best Practices zu befolgen — und bildet so eine nachhaltig iterierbare „organisatorische Wissensinfrastruktur"

1. Das Software Engineering durchläuft einen methodologischen Wandel

Das Software Engineering als Disziplin hat in den vergangenen fünf Jahrzehnten mehrere grundlegende methodologische Umbrüche erlebt. Angefangen mit Dijkstras Veröffentlichung von „Go To Statement Considered Harmful"[1] im Jahr 1968, die die Revolution der strukturierten Programmierung einleitete, über objektorientierte Programmierung, agile Entwicklung bis hin zu Cloud-nativen Architekturen — jeder Umbruch hat neu definiert, „wie gute Software gebaut werden sollte".

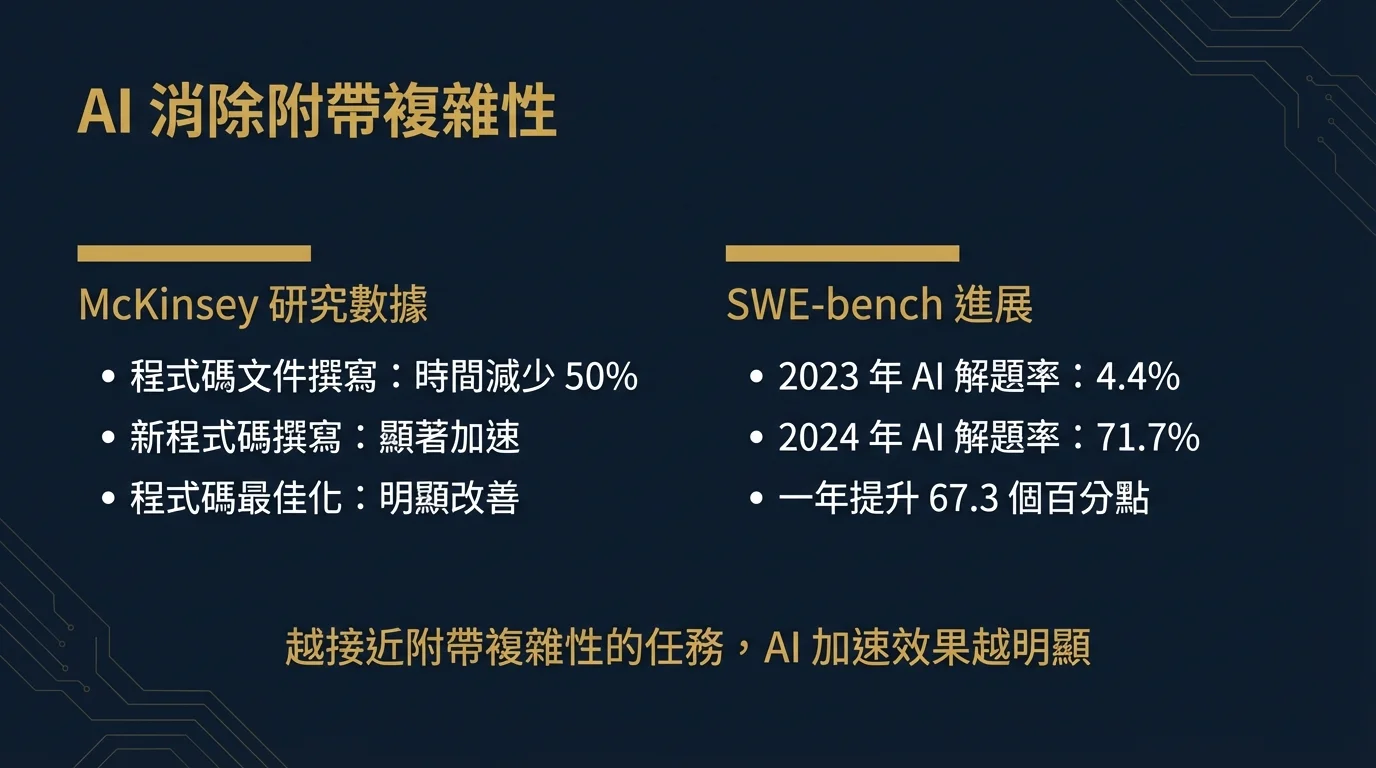

In den Jahren 2025–2026 befinden wir uns an einem erneuten methodologischen Wendepunkt. Die BCG-Studie[2] zeigt, dass bei Google und Microsoft rund 30 % des neuen Codes bereits von KI generiert werden und bestehende KI-gestützte Codierungstools eine Steigerung der Entwicklungsproduktivität um 30–50 % bewirken. Der Stanford AI Index Report 2025[3] dokumentiert darüber hinaus einen bemerkenswerten Fortschritt: Beim SWE-bench (einem Benchmark auf Basis realer GitHub-Softwareentwicklungsprobleme) stieg die Lösungsrate von KI-Systemen von 4,4 % im Jahr 2023 auf 71,7 % im Jahr 2024 — ein Anstieg um 67,3 Prozentpunkte innerhalb eines Jahres.

Diese Zahlen erzählen jedoch nur eine Seite der Geschichte. Die eigentlich relevante Frage lautet nicht „Kann KI programmieren?", sondern: Wenn KI immer mehr Aufgaben bei der Codegenerierung übernimmt — wie sollten sich Methodik, Teamstruktur und Architekturentscheidungen im Software Engineering entsprechend anpassen?

2. Die zeitgenössische Relevanz von Brooks' Rahmenwerk: Essenzielle und akzidentelle Komplexität

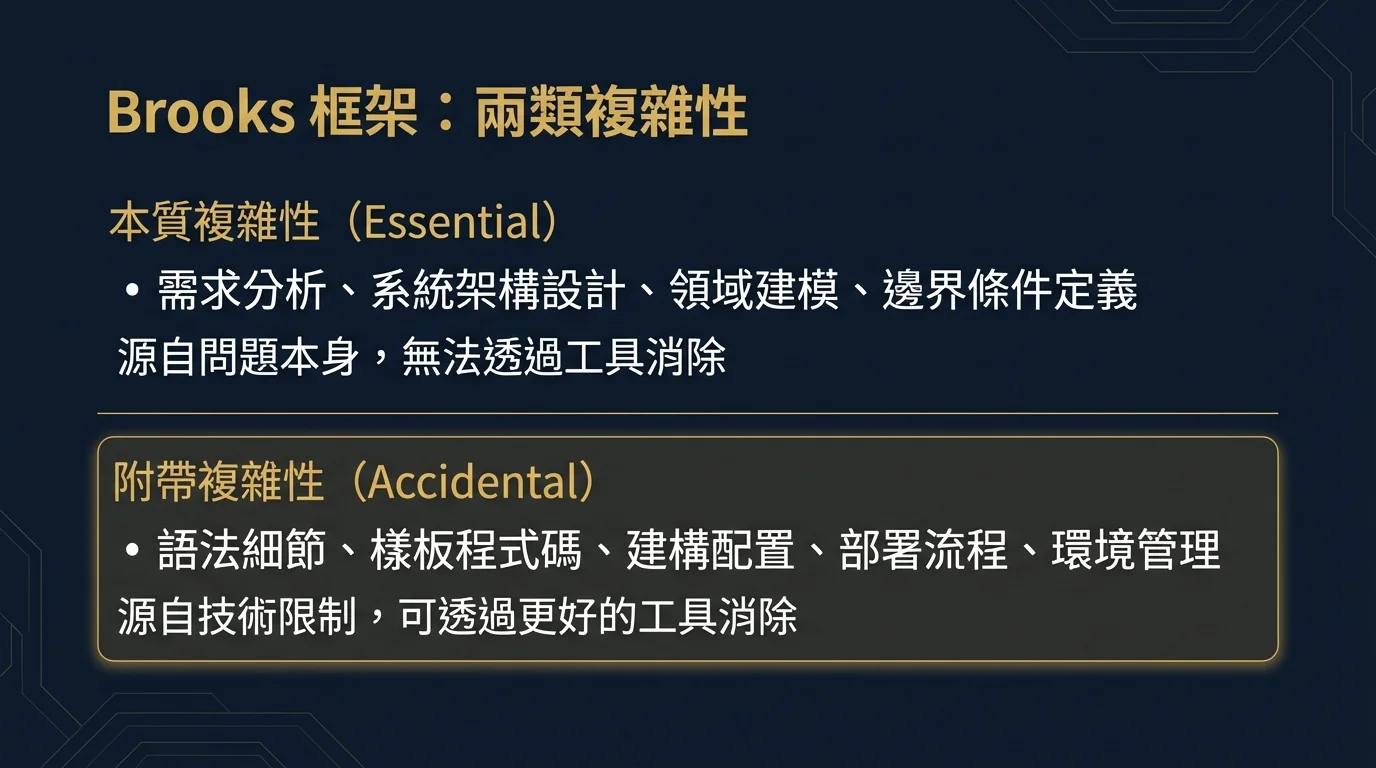

Um den Einfluss von KI auf das Software Engineering systematisch zu verstehen, bietet Frederick Brooks' 1987 veröffentlichter Aufsatz „No Silver Bullet"[4] nach wie vor das erklärungsstärkste analytische Rahmenwerk. Brooks unterschied zwei Arten von Komplexität in der Softwareentwicklung:

- Essenzielle Komplexität (Essential Complexity): Sie entspringt dem Problembereich selbst — Anforderungsanalyse, Systemarchitekturdesign, Domänenmodellierung, Definition von Randbedingungen. Diese Komplexität lässt sich nicht durch bessere Tools eliminieren, da sie ein inhärentes Merkmal des Problems selbst ist

- Akzidentelle Komplexität (Accidental Complexity): Sie entsteht durch Tools, Prozesse und technische Einschränkungen — Syntaxdetails, Boilerplate-Code, Build-Konfiguration, Deployment-Prozesse, Umgebungsmanagement. Diese Komplexität ist ein Produkt der gegenwärtigen technologischen Bedingungen und kann theoretisch durch bessere Tools eliminiert werden

Aus diesem Rahmenwerk betrachtet, wird die Wertpositionierung generativer KI deutlich: Sie eliminiert systematisch die akzidentelle Komplexität in der Softwareentwicklung. Codegenerierung, Dokumentation, Testerstellung, Boilerplate-Code — diese Arbeiten, die in der Vergangenheit einen erheblichen Teil der Entwicklerzeit beanspruchten, gehören ihrem Wesen nach allesamt zur akzidentellen Komplexität. McKinseys Studie[5] bestätigt dies: Die größte Zeitersparnis durch generative KI wird bei der Codedokumentation erzielt (Halbierung der Zeit), gefolgt vom Schreiben neuen Codes und dann von der Codeoptimierung. Je näher eine Aufgabe der „akzidentellen Komplexität" steht, desto deutlicher fällt der Beschleunigungseffekt durch KI aus.

Doch Brooks' Rahmenwerk enthält gleichzeitig eine Warnung: Essenzielle Komplexität verschwindet nicht durch den Fortschritt der Tools. Ob Anforderungen korrekt verstanden werden, ob die Architektur zum Problemumfang passt, ob Systemgrenzen sinnvoll gezogen sind — diese Urteile erfordern nach wie vor tiefe Domänenexpertise und Engineering-Erfahrung.

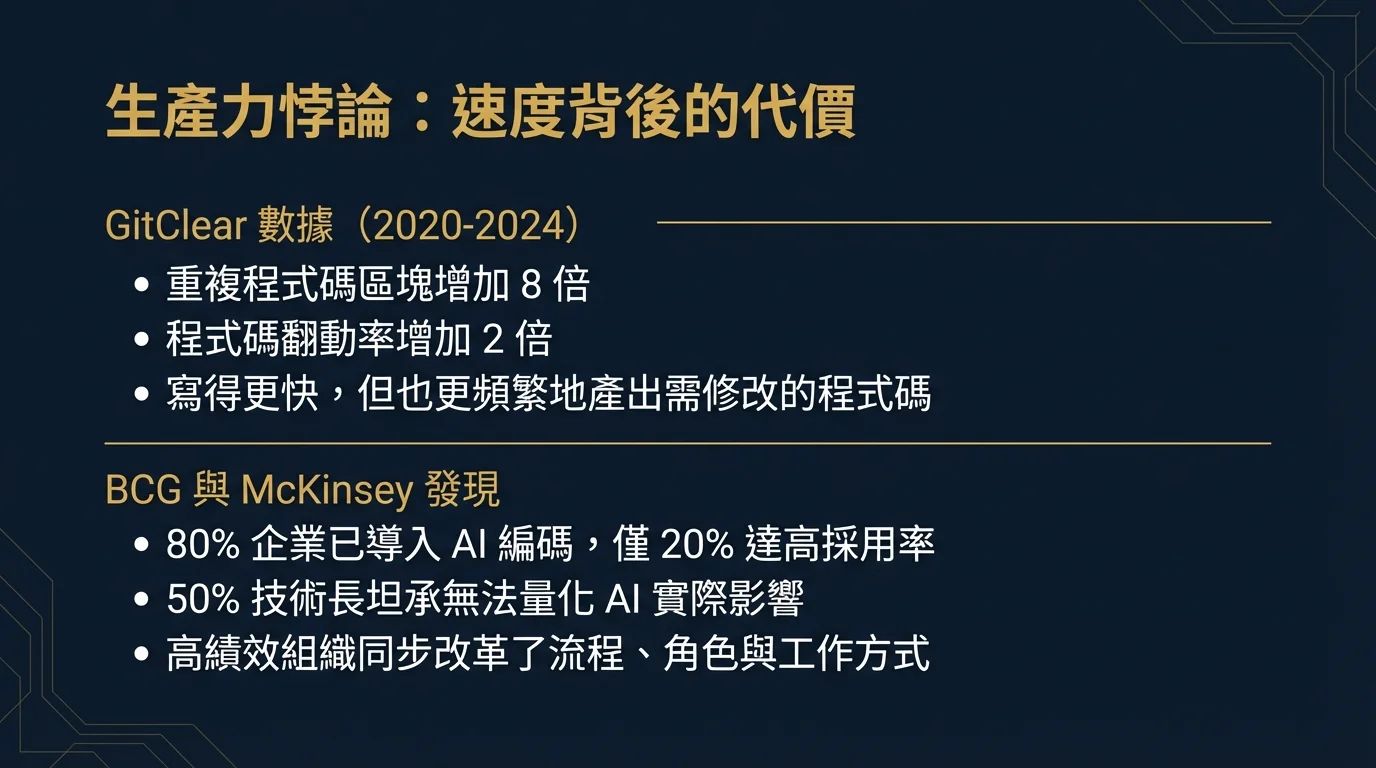

3. Das Produktivitätsparadoxon: Versteckte Kosten hinter der Geschwindigkeitssteigerung

Eine wichtige Studie im MIT Sloan Management Review von 2025[6] deckt ein Phänomen auf, das alle technischen Entscheidungsträger beachten sollten: Die Produktivitätssteigerung durch KI-gestützte Entwicklung ist nicht ohne Preis.

Die Studie verweist auf GitClears Analyse von Millionen von Codezeilen aus den Jahren 2020 bis 2024 und identifiziert zwei alarmierende Trends: Duplizierte Codeblöcke haben sich verachtfacht, und die Code-Churn-Rate (der Anteil von Code, der kurz nach dem Schreiben geändert oder gelöscht wird) hat sich verdoppelt. Mit anderen Worten: Entwickler schreiben tatsächlich schneller, produzieren aber auch häufiger Code, der anschließend geändert oder verworfen werden muss.

Die BCG-Studie[7] stellt weiterhin fest, dass zwar über 80 % der Unternehmen generative KI in ihre Entwicklungsprozesse integriert haben, jedoch nur 20 % eine Entwickler-Adoptionsrate von über 75 % erreichen. Zudem geben 50 % der CIOs zu, dass sie die tatsächliche Auswirkung von KI auf die Engineering-Effizienz nicht quantifizieren können. Die entscheidende Erkenntnis lautet: Veraltete Systemarchitekturen und unreife DevOps-Praktiken beeinträchtigen den Nutzen von KI-Tools erheblich — KI ist also kein Allheilmittel, sondern muss mit modernen Engineering-Praktiken zusammenwirken, um Wert zu entfalten.

McKinseys Untersuchung[8] von über 600 Organisationen zeichnet ein umfassenderes Bild: Die leistungsstärksten KI-Adoptoren erreichen tatsächlich 16–30 % Teamproduktivitätssteigerung und 31–45 % Softwarequalitätsverbesserung. Doch diese Organisationen zeichnen sich dadurch aus, dass sie nicht nur Tools eingeführt, sondern gleichzeitig Prozesse, Rollendefinitionen und Arbeitsweisen grundlegend reformiert haben. Organisationen, die Tools einführen, ohne ihre Methodik zu ändern, verzeichnen nur marginale Verbesserungen.

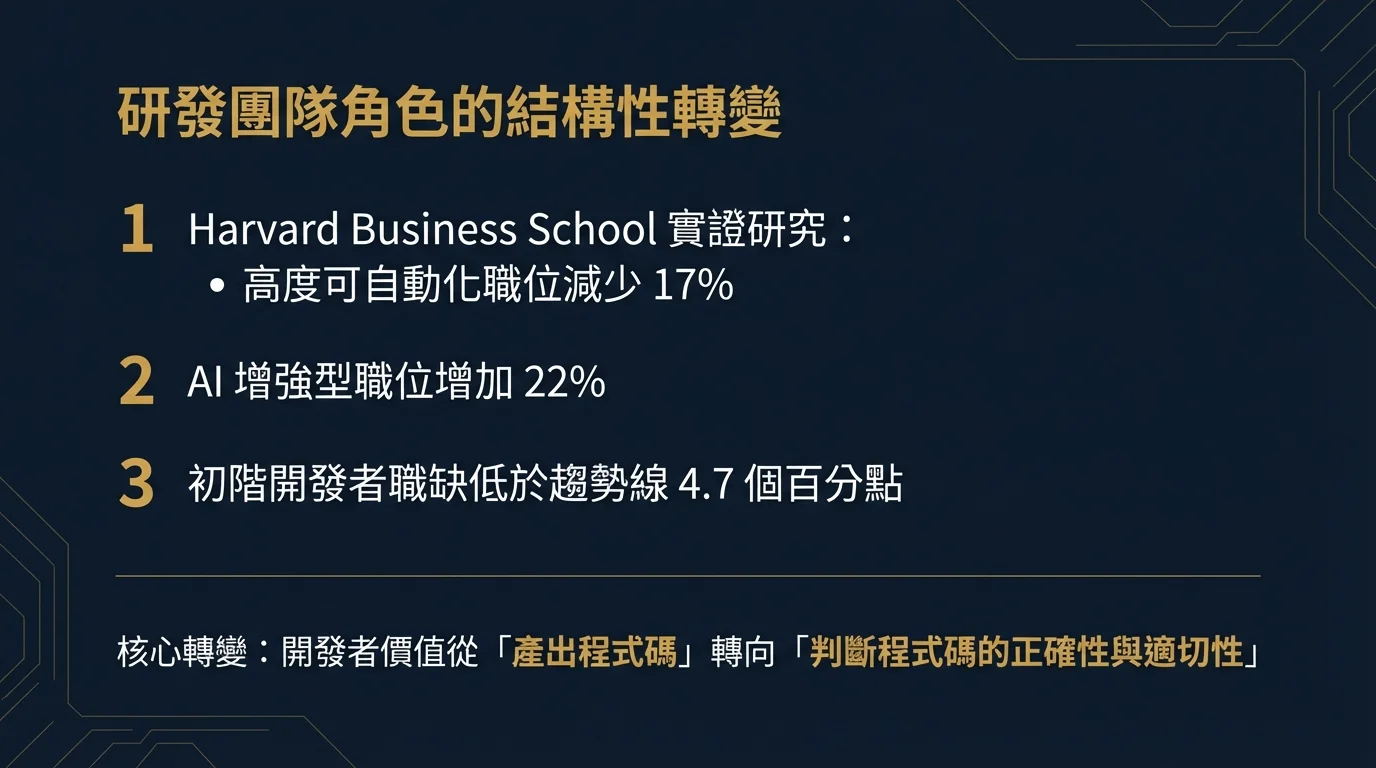

4. Der strukturelle Wandel der Rollen in Entwicklungsteams

Eine empirische Studie der Harvard Business School[9] zeigt anhand von Arbeitsmarktdaten die Auswirkungen von KI auf die Personalstruktur in der Softwareentwicklung: Hochgradig automatisierbare Stellen für strukturelle kognitive Aufgaben sind um 17 % zurückgegangen, während Stellen, in denen KI als Augmentierungswerkzeug dient, um 22 % zugenommen haben. Bemerkenswert ist, dass die Stellenangebote für Junior-Softwareentwickler 4,7 Prozentpunkte unter dem Trendwert liegen — nicht aufgrund von Entlassungen, sondern weil Unternehmen die Einstellung von Berufseinsteigern reduziert haben.

Diese Daten deuten auf einen strukturellen Wandel hin: Der Kernwert von Entwicklern verschiebt sich von „Code produzieren" hin zu „die Korrektheit und Angemessenheit von Code beurteilen". Ein Übersichtsartikel in den ACM Transactions on Software Engineering and Methodology von 2025[10] positioniert diesen Wandel als eine Neudefinition auf Disziplinebene des Software Engineering — von der Anforderungsanalyse über die Codegenerierung bis hin zu Test und Wartung durchdringt KI den gesamten Entwicklungslebenszyklus, während die menschliche Rolle zu übergeordneter Designbeurteilung und Qualitätssicherung migriert.

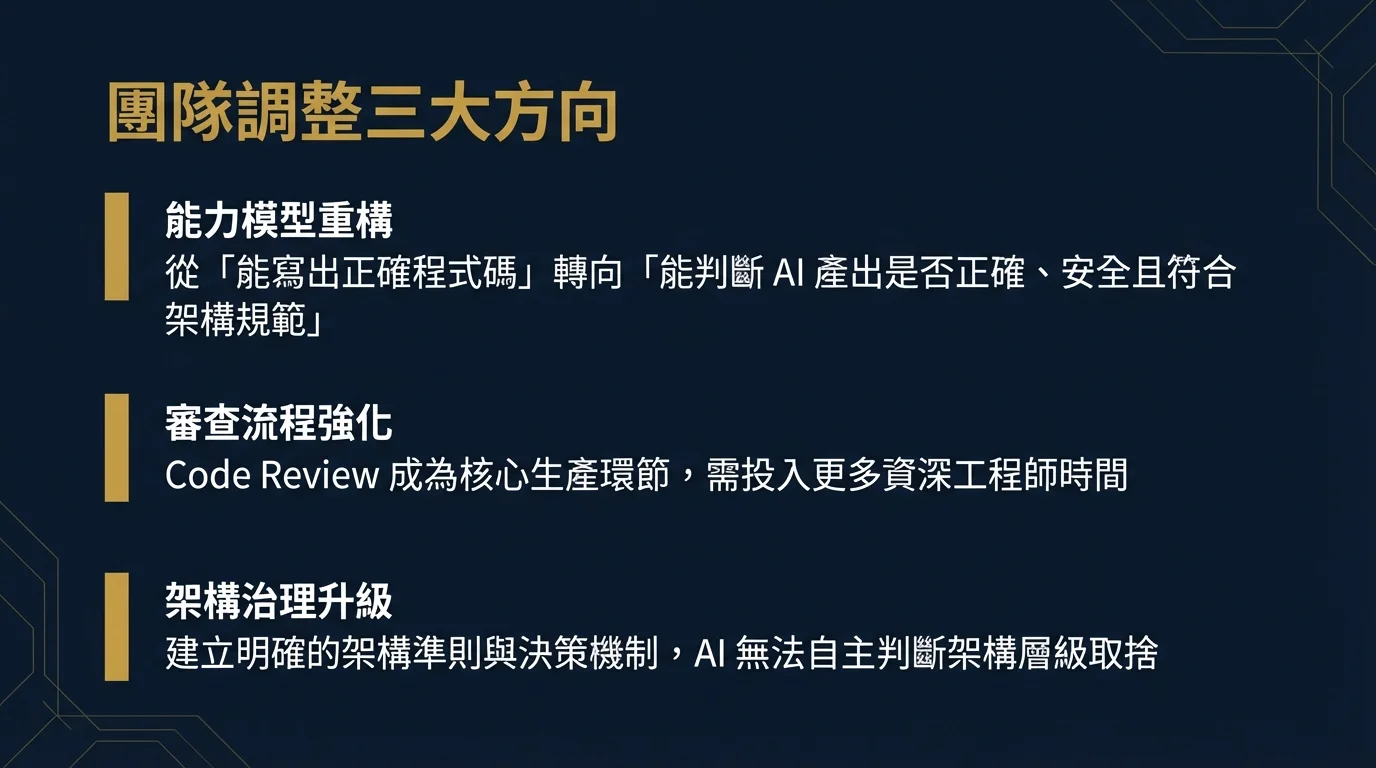

Für Leiter von Entwicklungsteams bedeutet dies drei konkrete Anpassungsrichtungen:

- Neuausrichtung des Kompetenzmodells: Der Fokus bei Rekrutierung und Weiterbildung muss sich von „korrekten Code schreiben können" hin zu „beurteilen können, ob KI-generierter Code korrekt, sicher und architekturkonform ist" verschieben

- Verstärkung der Review-Prozesse: Wenn ein Großteil des Codes von KI generiert wird, ist Code Review keine optionale Ergänzung mehr, sondern ein zentraler Produktionsschritt, der mehr Zeit erfahrener Ingenieure erfordert

- Aufwertung der Architektur-Governance: KI kann schnell Code produzieren, kann aber auf Architekturebene keine eigenständigen Abwägungen treffen — dies erfordert klare Architekturrichtlinien und Entscheidungsmechanismen

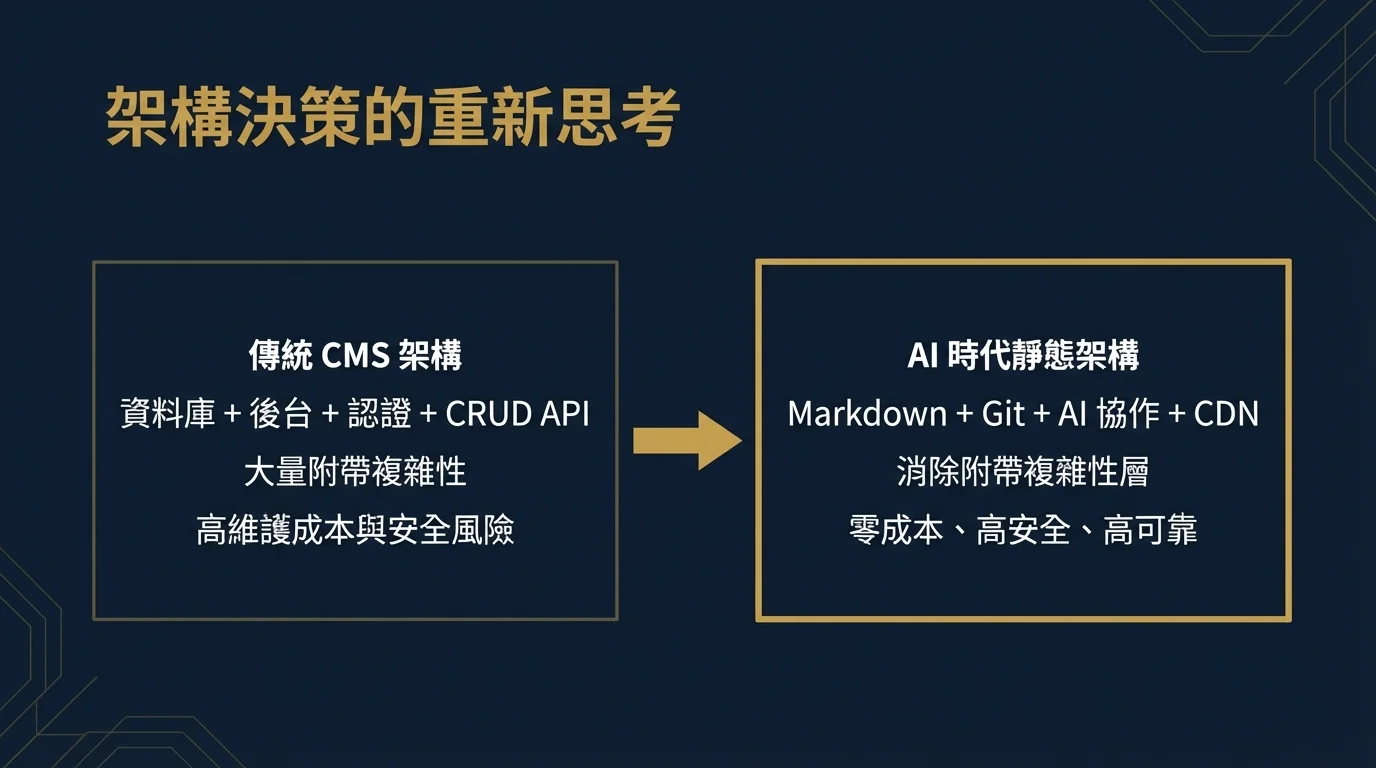

5. Architekturentscheidungen neu denken: Unnötige akzidentelle Komplexität eliminieren

Die Auswirkungen von KI auf die Softwareentwicklung sollten nicht auf der Ebene „schneller programmieren" stehen bleiben. Die tiefere Erkenntnis besteht darin, dass KI uns zwingt, viele als selbstverständlich angenommene Architekturentscheidungen zu überdenken.

Nehmen wir Content Management als Beispiel. Die traditionelle Veröffentlichung von Website-Inhalten erfordert nahezu zwangsläufig ein vollständiges CMS-Backend: Datenbankdesign, Benutzerauthentifizierung, CRUD-APIs, Verwaltungsoberfläche, Bild-Upload und -Speicherung, Serverwartung. Der Aufbau und die Wartung dieser Komponenten stellen eine erhebliche Engineering-Last dar — und sie gehören allesamt zu dem, was Brooks als „akzidentelle Komplexität" bezeichnete: Sie haben nichts mit dem essenziellen Ziel „hochwertige Inhalte veröffentlichen" zu tun, beanspruchen aber einen Großteil der Entwicklungs- und Betriebsressourcen.

Im Kontext KI-gestützter Entwicklung wird eine grundlegend andere Architektur möglich: Ein Static-Site-Generator in Kombination mit strukturierten Markdown-Dateien, unterstützt durch KI bei der Inhaltserstellung, Metadatengenerierung und Bildproduktion, mit einem Versionskontrollsystem (Git) zur Verwaltung von Inhaltsänderungen und automatischer Bereitstellung über ein CDN (wie Cloudflare Pages). Diese Architektur eliminiert sämtliche akzidentelle Komplexitätsschichten wie Datenbanken, Backend und Authentifizierungssysteme und bietet gleichzeitig höhere Sicherheit (kein angreifbares Backend), geringere Betriebskosten (statische Ressourcen kosten nahezu nichts) und bessere Zuverlässigkeit (kein Datenbankausfallrisiko).

Dies ist keine Abkürzung, sondern eine sachgerechte Architekturentscheidung im KI-Zeitalter. Wenn generative KI Aufgaben wie Inhaltsformatierung und Metadatengenerierung effizient übernehmen kann, werden eigens dafür gebaute Backend-Systeme zu unnötiger akzidenteller Komplexität. Ebenso wie das Aufkommen von Compilern das handgeschriebene Assemblerprogrammieren überflüssig machte, lässt die Reife der KI viele zuvor als notwendig erachtete Architekturschichten ihre Daseinsberechtigung verlieren.

6. Strukturierte Konservierung von Organisationswissen: Eine neue Art von Wissenskapital

Ein weiterer wichtiger Trend, den wir in der Praxis beobachten, ist die grundlegende Veränderung der Art und Weise, wie Teams ihr Enterprise Knowledge Management betreiben.

Traditionelles Wissensmanagement im Software Engineering stützt sich auf Dokumentation (Wikis, Confluence), Code-Kommentare, mündliche Überlieferung und Erfahrungsweitergabe in Code Reviews. Die gemeinsame Einschränkung dieser Methoden ist: Die Konsumenten des Wissens sind Menschen, und das menschliche Lesen, Verstehen und Anwenden unterliegt Verlusteffekten. Ein umfassendes Coding-Standards-Dokument wird möglicherweise nach der Erstellung nie wieder gelesen; immer wieder auftauchende gleiche Probleme in Code Reviews belegen die Ineffizienz der Wissensvermittlung.

Im Workflow der KI-gestützten Entwicklung eröffnet sich eine neue Möglichkeit: Organisationswissen so zu strukturieren, dass es direkt von KI konsumiert werden kann.

Konkret hat unser Team Entwicklungsstandards, Architekturentscheidungs-Protokolle, häufige Fallstricke und Qualitätsstandards systematisch in strukturierte Markdown-Dateien oder KI-Skill-Definitionen (Skills) überführt. Wenn KI-Tools Aufgaben ausführen, werden diese Dateien automatisch als Kontext geladen, sodass die KI bei jeder Codegenerierung den Best Practices des Teams folgt — ohne dass Entwickler Dokumente nachschlagen oder sich erinnern müssen.

Im Kern handelt es sich um eine neue Art von „organisatorischer Wissensinfrastruktur":

- Verlustfreie Übertragung: KI liest strukturierte Dokumente und wendet sie sofort an — ohne den Verlust, der beim menschlichen Lesen und Verstehen entsteht

- Durchgängige Konsistenz: Unabhängig davon, ob erfahrene Ingenieure oder neue Teammitglieder KI-Tools nutzen — die Ergebnisse folgen denselben Qualitätsstandards

- Iterative Weiterentwicklung: Jedes Mal, wenn eine neue Best Practice oder ein Fallstrick entdeckt wird, genügt eine Dokumentaktualisierung, um sich sofort in allen nachfolgenden Ergebnissen widerzuspiegeln

Wenn man dieses Konzept auf eine tiefere Ebene bringt: Im KI-Zeitalter besteht das wertvollste Kapital eines Entwicklungsteams nicht nur aus den technischen Fähigkeiten seiner Mitglieder, sondern vor allem aus dem strukturiert konservierten kollektiven Urteilsvermögen und der Domänenerfahrung. Mitarbeiter wechseln, Erinnerungen verblassen — aber korrekt strukturierte Wissensdokumente ermöglichen es KI-Tools, kontinuierlich auf dem höchsten Niveau des Teams zu arbeiten.

7. Systematische Empfehlungen für technische Entscheidungsträger

Auf Basis der vorstehenden Analyse und unserer praktischen Erfahrung geben wir technischen Entscheidungsträgern, die eine Entwicklungsstrategie für das KI-Zeitalter planen, folgende Empfehlungen:

7.1 Bestehende Architektur mit Brooks' Rahmenwerk auditieren

Überprüfen Sie Ihre bestehende technische Architektur systematisch und unterscheiden Sie zwischen essenzieller und akzidenteller Komplexität. Bei Bereichen mit hoher akzidenteller Komplexität (Boilerplate-Code, Build-Konfiguration, Content-Management-Backends, repetitive CRUD-Schichten) sollten Sie evaluieren, ob diese durch KI-Unterstützung oder Architekturvereinfachung eliminiert werden können. Die Studie des MIT Sloan[6] erinnert uns daran, dass KI-generierter Code in Legacy-Umgebungen (Brownfield) bestehende Probleme verschärfen kann — daher sollte die Architekturvereinfachung der Einführung von KI-Tools vorausgehen.

7.2 Prozesse und Rollendefinitionen gleichzeitig reformieren

Die McKinsey-Daten[8] zeigen eindeutig: Organisationen, die lediglich Tools einführen, ohne ihre Arbeitsweise zu ändern, verzeichnen kaum Verbesserungen. Die Einführung von KI-Tools sollte mit einer Stärkung der Code-Review-Prozesse, einer Anpassung des Kompetenzmodells für Entwickler und der Etablierung von Architektur-Governance-Mechanismen einhergehen. Die Zeit erfahrener Ingenieure sollte von „Code schreiben" auf „Code überprüfen" und „Architekturrichtlinien definieren" umverteilt werden.

7.3 In die Strukturierung von Organisationswissen investieren

Überführen Sie die Coding Standards, Architecture Decision Records (ADR), häufige Fehlermuster und Qualitätsstandards Ihres Teams systematisch in strukturierte Dokumente. Dies ist eine der Engineering-Investitionen mit dem höchsten KI-ROI im KI-Zeitalter — sie verbessert nicht nur die Qualität der KI-Tool-Ergebnisse, sondern schafft auch ein nachhaltig weiterentwickelbares Wissenskapital für die Organisation.

7.4 Quantitatives Monitoring von Technical Debt etablieren

Angesichts der Tatsache, dass KI-gestützte Entwicklung die Anhäufung von Technical Debt beschleunigen kann[6], ist die Etablierung quantitativer Monitoring-Mechanismen für Codequalität von entscheidender Bedeutung. Verfolgen Sie Schlüsselmetriken wie Duplikationsrate, Churn-Rate und Komplexitätsindikatoren, um sicherzustellen, dass die Steigerung der Entwicklungsgeschwindigkeit nicht auf Kosten langfristiger Wartungskosten geht.

8. Fazit: Methodologischer Wandel statt bloßer Werkzeugersetzung

Zurück zu Brooks' Einsicht von vor fast vier Jahrzehnten: Die grundlegende Herausforderung des Software Engineering liegt nicht in den Werkzeugen, sondern in der Komplexität des Problems selbst. Generative KI ist ein mächtiges Werkzeug, das akzidentelle Komplexität mit beispielloser Geschwindigkeit eliminiert — doch essenzielle Komplexität — Anforderungen verstehen, Architekturen entwerfen, korrekte Engineering-Urteile fällen — bleibt eine unverzichtbare Domäne des Menschen.

Entscheidend ist nicht, „ob man KI zum Programmieren einsetzt", sondern ob ein Unternehmen in der Lage ist, mit Unterstützung der KI Architekturentscheidungen neu zu bewerten, Teamrollen neu zu definieren und Wissensmanagement grundlegend zu überdenken. Organisationen, die KI lediglich als „schnellere Schreibkraft" betrachten, werden letztlich von jenen übertroffen, die verstehen, dass es sich um einen methodologischen Wandel handelt.

Wenn Ihr Entwicklungsteam derzeit evaluiert, wie KI-Tools systematisch integriert, Entwicklungsprozesse umstrukturiert oder eine organisatorische Wissensinfrastruktur aufgebaut werden kann, verfügt unser Team über umfassende Erfahrung von der akademischen Forschung bis zur praktischen Umsetzung. Wir freuen uns auf ein tiefgehendes technisches Gespräch mit Ihnen.